Цветовое пространство yuv: Выбор цветового пространства при работе с цифровым видео

Выбор цветового пространства при работе с цифровым видео

Речь в сегодняшней статье пойдет о цветовых пространствах. Ограничимся рассмотрением лишь тех из них, которые сейчас широко применяются в компьютерном видео. Как уже говорилось в предыдущей статье «Захват видео с помощью Virtual Dub» (см. КГ №№ 19, 20), от выбора цветового пространства зависит размер получаемого промежуточного файла. Забегая вперед, можно сказать, что правильный выбор цветового пространства позволит ускорить и последующую обработку видео. В свое время, пытаясь найти дополнительную информацию о таинственном формате YUV, я обратил внимание на ничтожно малое количество источников по этой теме в Интернет. Что касается русскоязычных, то их вовсе нет. В конце концов, читая о том, что кодек «теперь поддерживает цветовое пространство YUV, и поэтому быстрее и качественнее кодирует и декодирует видео», пытаешься найти этому обоснование. Но в итоге это лишь собственное мнение того или иного автора. Англоязычный источник оказался буквально один — книга Video Demystified.

Перейдем к делу. Прежде всего, цветовое пространство — это математическое представление некоторого набора цветов. Существует несколько основных математических моделей, среди которых нас интересуют только YUV и RGB. На основе теоретических данных попробуем определить, которая из них больше подходит для кодирования видео.

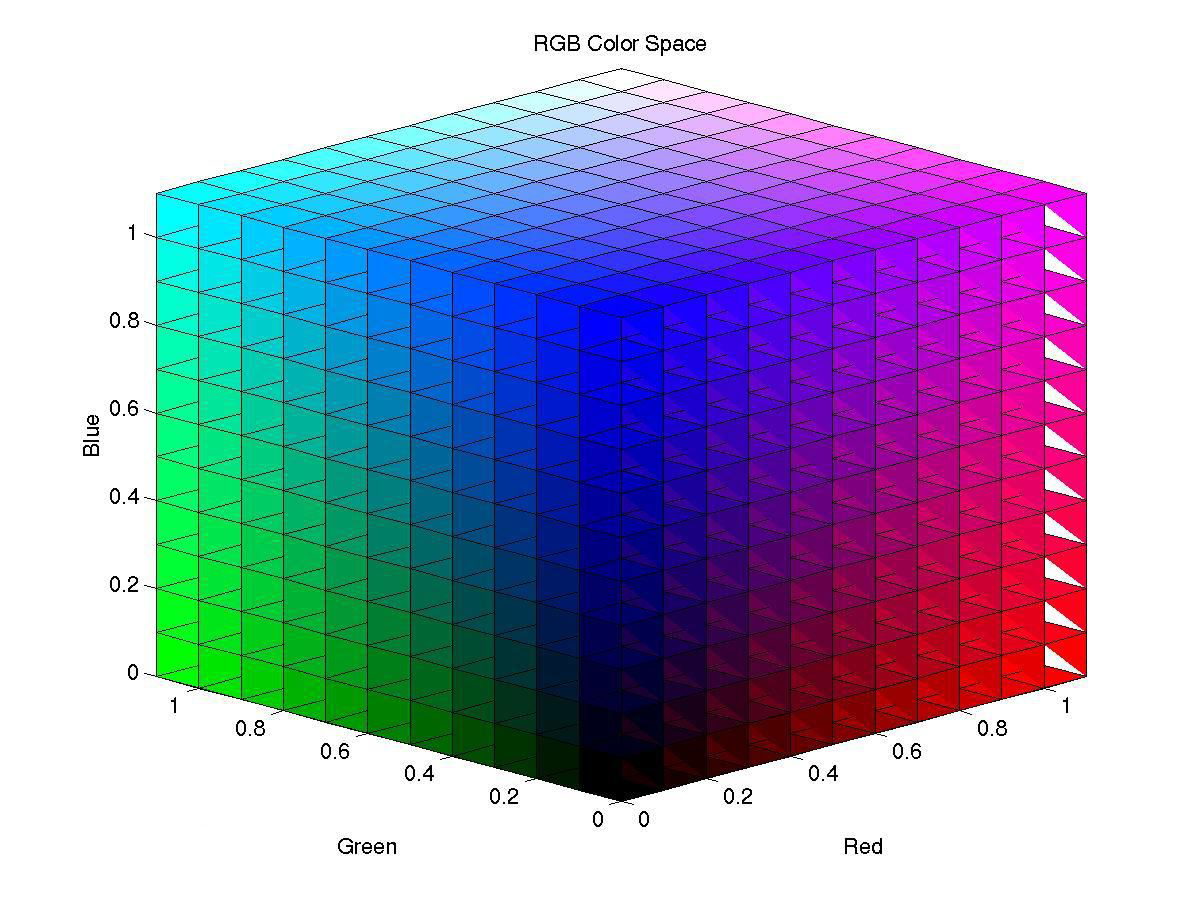

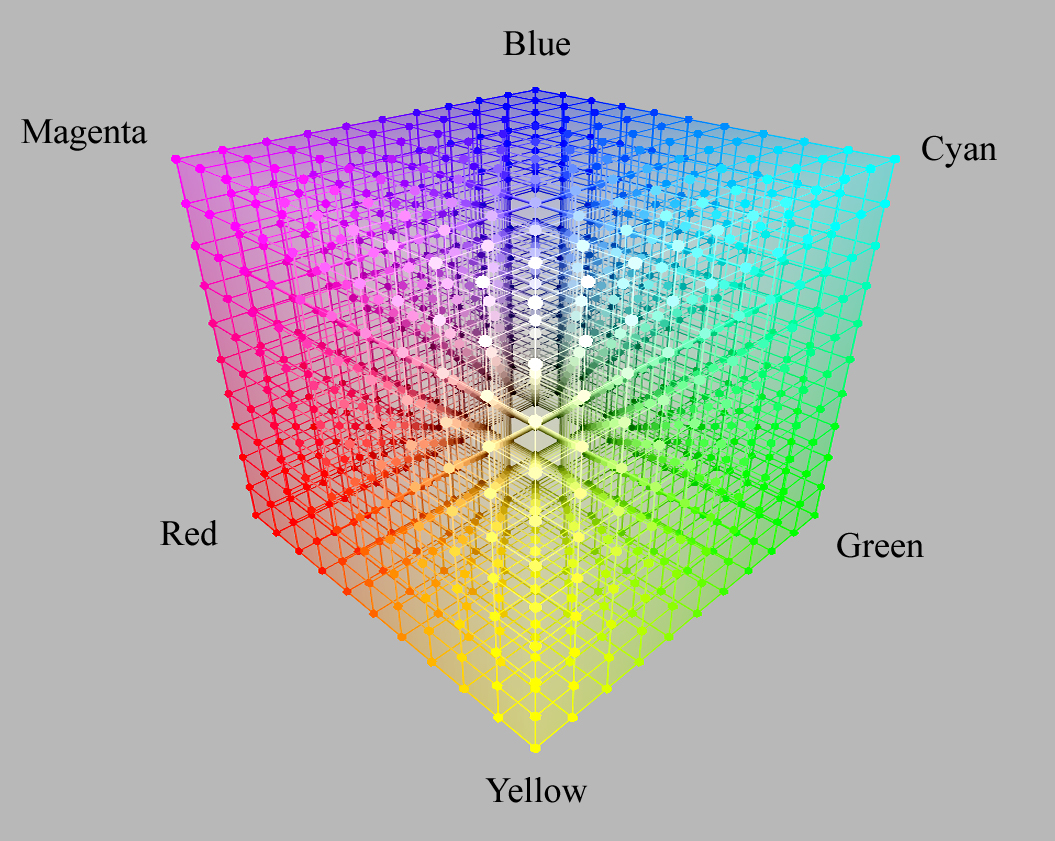

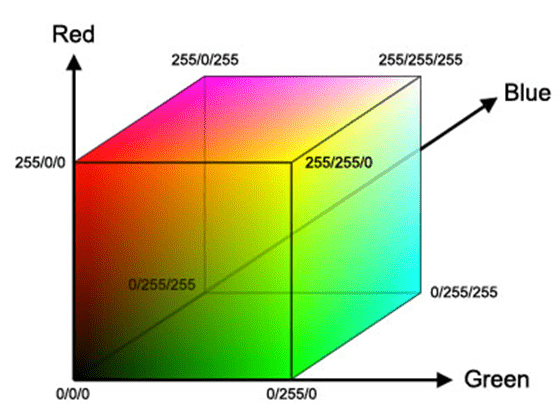

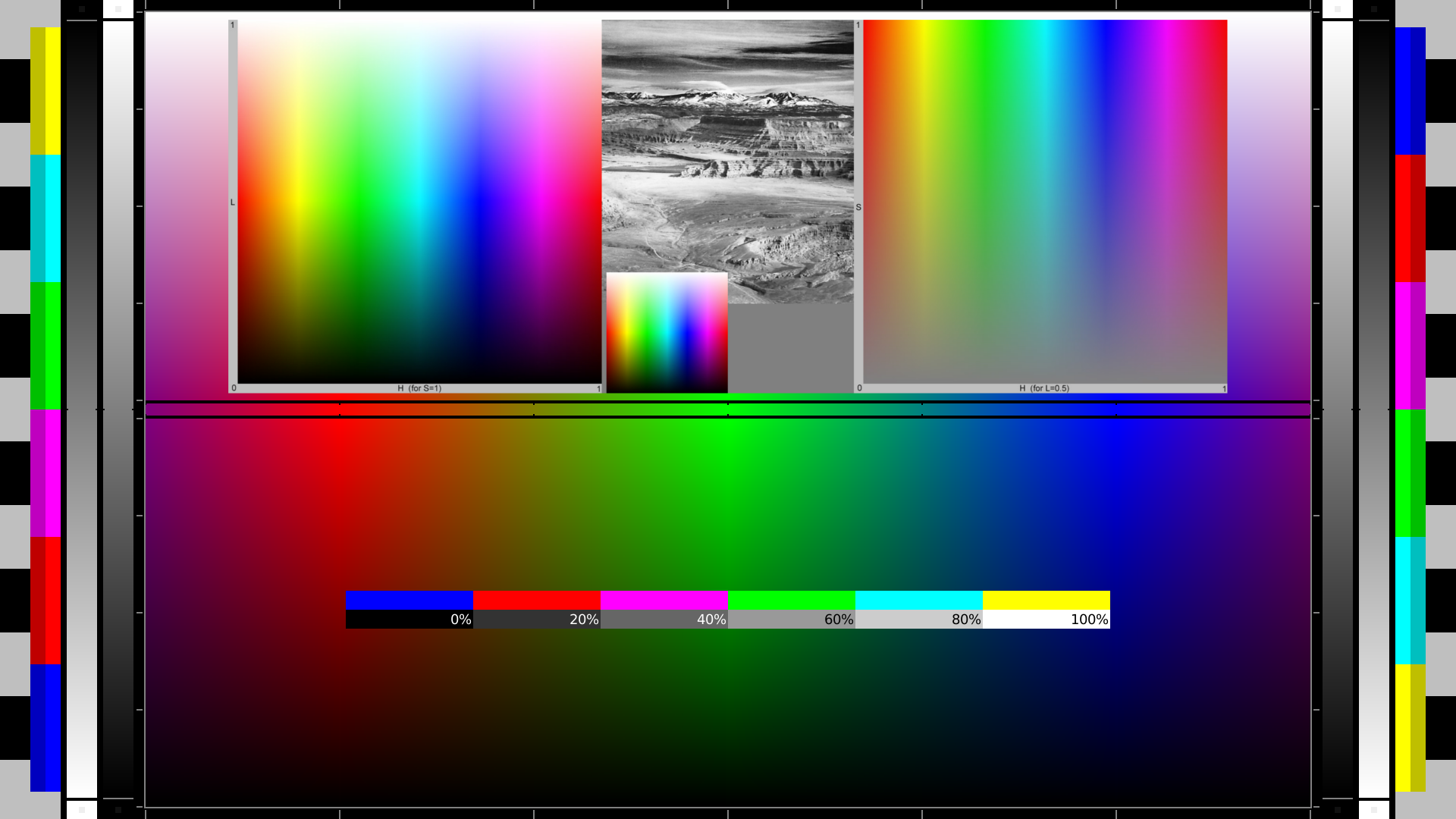

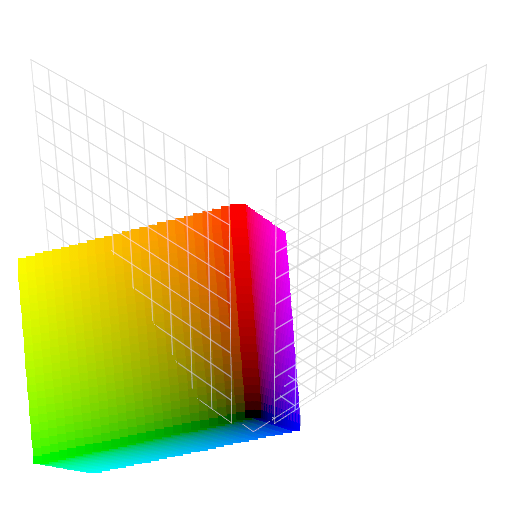

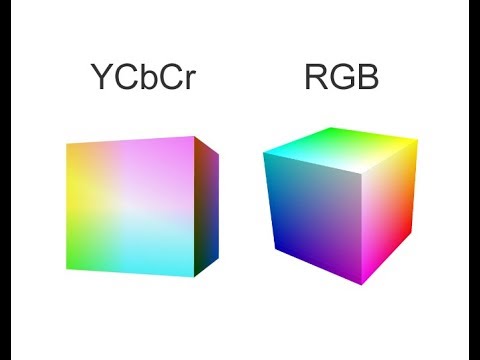

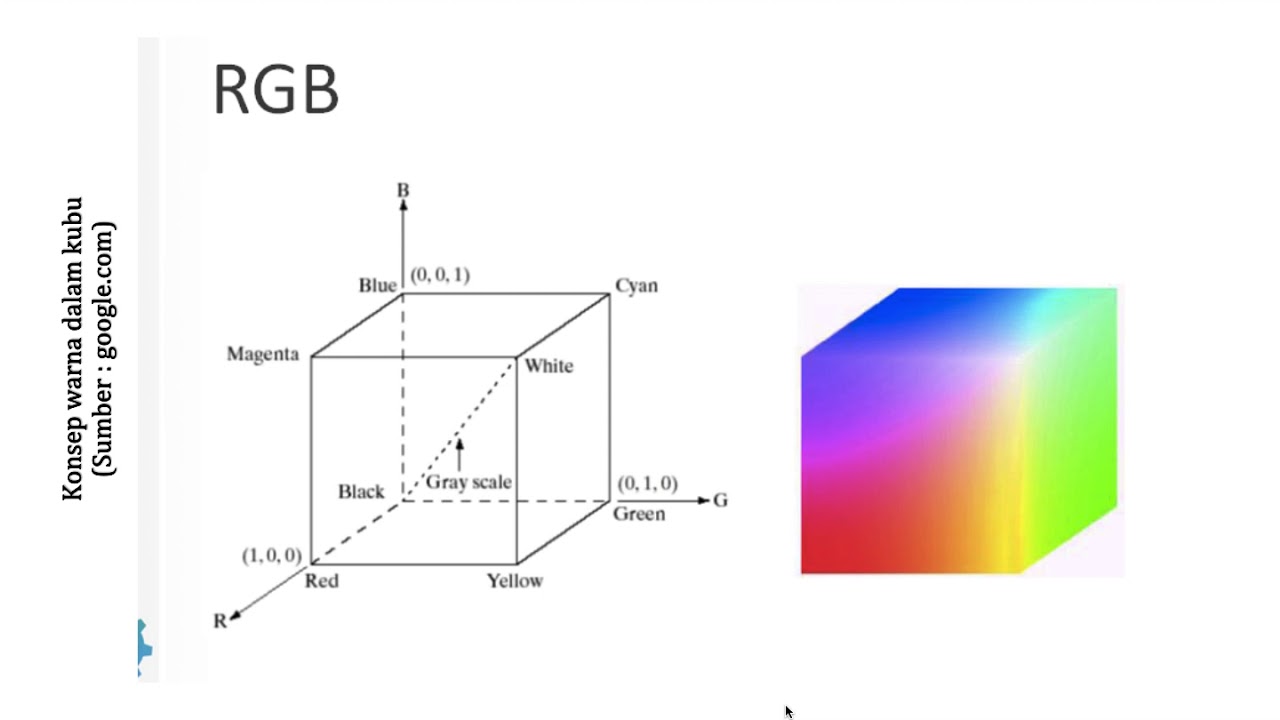

RGB. Название цветового пространства — аббревиатура от слов Red (красный), Green (зеленый), Blue (синий). Эти три составляющих используются для представления произвольного цвета. Куб RGB представлен на рис. 1. Данное цветовое пространство применяется в компьютерной графике, потому что такая организация упрощает архитектуру системы.

Рис. 1. Куб RGB

YUV. Может показаться, что это тоже аббревиатура. Однако нет, это просто буквенные обозначения составляющих. Назначение этого цветового пространства — видеотехника. Оно и применяется в стандартах PAL (Phase Alternation Line), NTSC (National Television System Committee), SECAM (Sequential Color with Memory). Модель основана на представлении в виде трех составляющих: яркости (luma — Y) и цветоразностей (U и V). Как видим, для представления черно-белого изображения потребуется всего одна составляющая (против трех у RGB), что существенно упрощает хранение, обработку и передачу такой информации. Координата Y является диагональю куба RGB, поэтому и возникает резонный вопрос: а как эти цветовые пространства сопоставимы между собой? Формулы для представления YUV через известные значения RGB следующие:

Однако нет, это просто буквенные обозначения составляющих. Назначение этого цветового пространства — видеотехника. Оно и применяется в стандартах PAL (Phase Alternation Line), NTSC (National Television System Committee), SECAM (Sequential Color with Memory). Модель основана на представлении в виде трех составляющих: яркости (luma — Y) и цветоразностей (U и V). Как видим, для представления черно-белого изображения потребуется всего одна составляющая (против трех у RGB), что существенно упрощает хранение, обработку и передачу такой информации. Координата Y является диагональю куба RGB, поэтому и возникает резонный вопрос: а как эти цветовые пространства сопоставимы между собой? Формулы для представления YUV через известные значения RGB следующие:

Y=0.299R’+0.587G’+0.114B’

U=-0.147R’-0.289G’+0.436B’=0.492 (B’-Y)

V=0.615R’-0.515G’-0.100B’=0.877(R’-Y)

Обратные формулы имеют следующий вид:

R’=Y+1.140V

G’=Y-0.394U-0.581V

B’=Y+2.032U

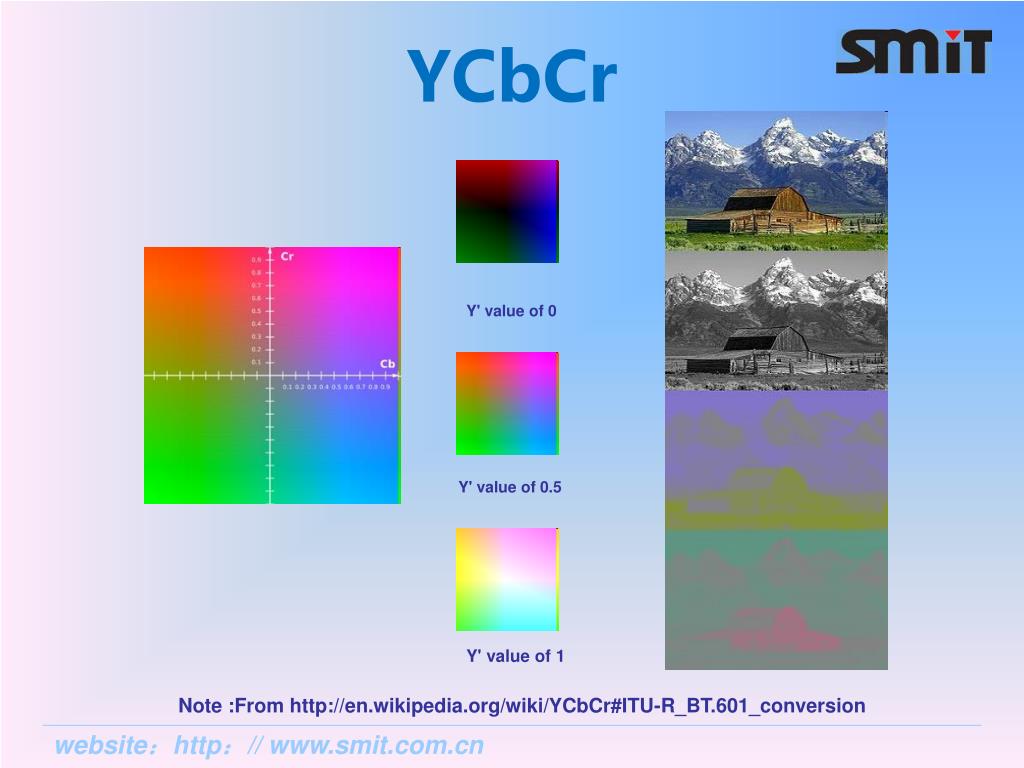

Здесь вместо значений R, G, B используются скорректированные значения R’, G’, B’. Формулы корректирования просты и зависят от конкретного стандарта, поэтому подробно на этом останавливаться не будем. В цифровой технике диапазон значений RGB составляет [0; 255] для каждого компонента, тогда как для компонентов цветового пространства YUV диапазоны следующие: [0; 255] для Y, [-112; 112] для U и [-157; 157] для V. Обратите внимание на формулы U и V. Они связаны с возможностями современной техники. Из них следует, что на современном этапе техника может воспроизводить лишь около половины диапазона значений B’-Y и почти вдвое больше значений диапазона R’-Y. Кроме YUV, можно встретить еще и такие названия: YIQ, YDbDr, YCbCr. Это не другие модели, это разновидности YUV. Отличаются они коэффициентами в формулах и стандартами, в которых применяются. YIQ применяется в стандарте NTSC, YDbDr — в SECAM. На YCbCr мы остановимся подробнее, потому что именно эта версия цветового пространства YUV применяется для цифрового видео и, значит, имеет прямое отношение к таким понятиям, как DVD, DVB, MPEG — словом, ко всему тому, с чем сегодня ассоциируется цифровое видео.

Формулы корректирования просты и зависят от конкретного стандарта, поэтому подробно на этом останавливаться не будем. В цифровой технике диапазон значений RGB составляет [0; 255] для каждого компонента, тогда как для компонентов цветового пространства YUV диапазоны следующие: [0; 255] для Y, [-112; 112] для U и [-157; 157] для V. Обратите внимание на формулы U и V. Они связаны с возможностями современной техники. Из них следует, что на современном этапе техника может воспроизводить лишь около половины диапазона значений B’-Y и почти вдвое больше значений диапазона R’-Y. Кроме YUV, можно встретить еще и такие названия: YIQ, YDbDr, YCbCr. Это не другие модели, это разновидности YUV. Отличаются они коэффициентами в формулах и стандартами, в которых применяются. YIQ применяется в стандарте NTSC, YDbDr — в SECAM. На YCbCr мы остановимся подробнее, потому что именно эта версия цветового пространства YUV применяется для цифрового видео и, значит, имеет прямое отношение к таким понятиям, как DVD, DVB, MPEG — словом, ко всему тому, с чем сегодня ассоциируется цифровое видео.

Это цветовое пространство описано в рекомендациях ITU-R BT.601 (или, как часто упоминается в различного рода документах, сокращенно BT.601). Y может принимать значения [16; 235], Cb и Cr могут принимать значения [16; 240]. Значения, исключенные из этого диапазона, используются при видеообработке. В ином случае их принято относить к шумам. Обращайте внимание при изучении документации, что тот или иной программный продукт написан с учетом рекомендаций BT.601. Это будет означать, что продукт не выдает значений YCbCr вне указанных диапазонов. К слову, значения составляющих для различных цветов будут разными в зависимости от того, имеем мы дело с SDTV (Standart Definition TV — телевидение стандартной четкости) или HDTV (High Definition TV — телевидение высокой четкости). Кроме того, формулы RGB<=>YCbCr для компьютерных систем будут немного отличаться от «оригинальных». Рекомендации BT.601 относятся к SDTV, о котором и пойдет речь далее (для HDTV у рекомендаций другой номер — 709).

Y=0.257R’+0.504G’+0.098B’+16

Cb=-0.148R’-0.291G’+0.439B’+128

Cr=0.439R’-0.368G’-0.071B’+128

И обратные формулы:

R’=1.164(Y-16)+1.596(Cr-128)

G’=1.164(Y-16)-0.813(Cr-128)-0.392(Cb-128)

B’=1.164(Y-16)+2.017(Cb-128)

Обратите внимание, что обратные формулы могут давать значения R’G’B’ вне допустимого диапазона [0; 255]. Об этом немного ниже. А сейчас постараемся разобраться в понятиях YUY2 и YV12, которые так часто встречаются. Перед тем или иным вариантом YCbCr написан его код — например, 4:4:4 или 4:2:0. Для простоты восприятия можно предложить следующую «расшифровку». Для описания точки требуется 3 фрагмента (сэмпла): Y, Cb, Cr. Первая цифра кода указывает, в скольких из 4 столбцов присутствует сэмпл Y. Информация о яркости является более важной в сравнении с информацией о цветоразности, и поэтому не исключается. Вторая цифра указывает, сколько столбцов из 4 содержат сэмплы Cb и Cr в нечетных строках или в нечетных полукадрах, третья содержит такую же информацию, но только о четных строках или четных полукадрах.

Рис. 2. Структура формата 4:4:4

Формат 4:2:2 YCbCr является 16-битным. И, как видно из рис. 3, каждый второй сэмпл Cb и Cr исключен. А при декодировании видео отсутствующие значения досчитываются, исходя из информации о соседних «неурезанных» точках. Как уже говорилось, информация о цветоразности не так важна, как о яркости. Исходя из того, что резко изменяться значения составляющих для двух соседних точек не могут, и стало возможным исключение каждого второго сэмпла Cb и Cr. Обратите внимание на окно Color Depth (рис. 4) программы Virtual Dub (см. статью «Virtual Dub. Настройки и

Как уже говорилось, информация о цветоразности не так важна, как о яркости. Исходя из того, что резко изменяться значения составляющих для двух соседних точек не могут, и стало возможным исключение каждого второго сэмпла Cb и Cr. Обратите внимание на окно Color Depth (рис. 4) программы Virtual Dub (см. статью «Virtual Dub. Настройки и

разновидности»). Как видим, в списке присутствуют три формата 4:2:2 YCbCr. Разница между UYVY и YUY2 такова, что в макропикселе (это условная точка, состоящая из двух реальных точек) у них разный порядок следования информации о составляющих. Говоря проще, YUY2 — это инвертированный формат UYVY. Формат YV16 отличается тем, что использует совершенно иной способ хранения информации о точках.

Рис. 3. Структура формата 4:2:2

Рис. 4. Окно Color Depth программы Virtual Dub

Есть смысл внести некоторую ясность в способы хранения информации о точках. Способов этих два. Первый, как говорилось выше, заключается в том, что информация хранится в макропикселях. Группа форматов, использующих такой способ, называется packed (упакованный). Другая группа называется planar (плоскостной, планарный) и отличается тем, что информация о каждой составляющей хранится в отдельном массиве. То есть отдельная точка может быть получена путем извлечения соответствующих значений составляющих из отдельных массивов (плоскостей). Формат 4:2:0 YCbCr является 12- битным. Но не стоит думать, что он годится для воспроизведения видео для мобильных телефонов:). Удивитесь, но именно этот формат используется стандартами MPEG-1 и MPEG-2 (самое время ужаснуться: DVD-видео использует 12-битный цвет). На рис. 5, 6 показаны две разновидности 4:2:0 YCbCr, отличающиеся в стандартах MPEG-1 и MPEG-2. Есть и еще одна разновидность 4:2:0 YCbCr — так называемая совмещенная (предыдущие форматы, которые мы рассмотрели, были совмещенными, потому что сэмплы Cb, Cr «совмещены» с Y). Она используется DV-приложениями. В Virtual Dub есть один планарный формат 4:2:0 YCbCr-YV12. Отвлечемся и еще раз затронем тему воспроизведения оцифрованного в MPEG-2 видео — тех самых DVD, которые должны обеспечивать высокое качество.

Группа форматов, использующих такой способ, называется packed (упакованный). Другая группа называется planar (плоскостной, планарный) и отличается тем, что информация о каждой составляющей хранится в отдельном массиве. То есть отдельная точка может быть получена путем извлечения соответствующих значений составляющих из отдельных массивов (плоскостей). Формат 4:2:0 YCbCr является 12- битным. Но не стоит думать, что он годится для воспроизведения видео для мобильных телефонов:). Удивитесь, но именно этот формат используется стандартами MPEG-1 и MPEG-2 (самое время ужаснуться: DVD-видео использует 12-битный цвет). На рис. 5, 6 показаны две разновидности 4:2:0 YCbCr, отличающиеся в стандартах MPEG-1 и MPEG-2. Есть и еще одна разновидность 4:2:0 YCbCr — так называемая совмещенная (предыдущие форматы, которые мы рассмотрели, были совмещенными, потому что сэмплы Cb, Cr «совмещены» с Y). Она используется DV-приложениями. В Virtual Dub есть один планарный формат 4:2:0 YCbCr-YV12. Отвлечемся и еще раз затронем тему воспроизведения оцифрованного в MPEG-2 видео — тех самых DVD, которые должны обеспечивать высокое качество.

Рис. 5. Структура формата 4:2:0 (MPEG-2)

Рис.

6. Структура формата 4:2:0 (MPEG-1, H.261, H.263)

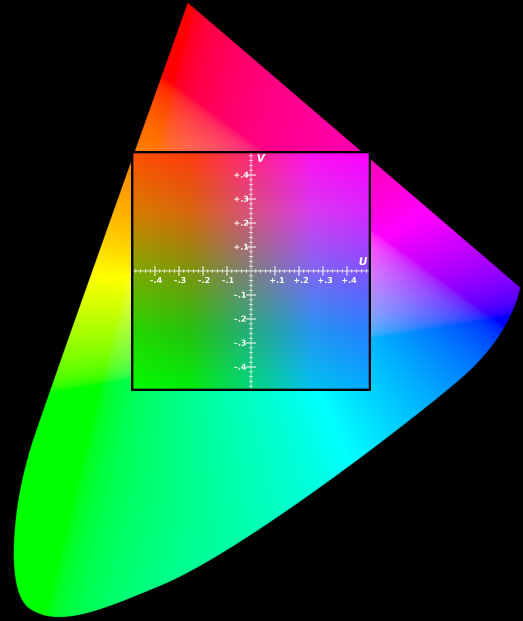

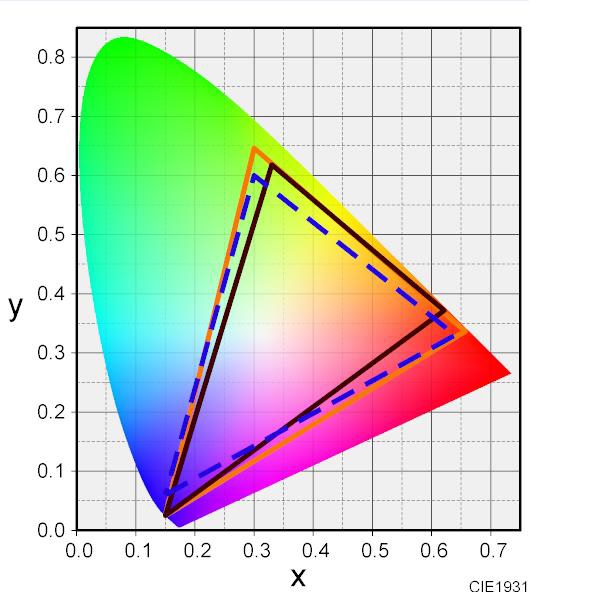

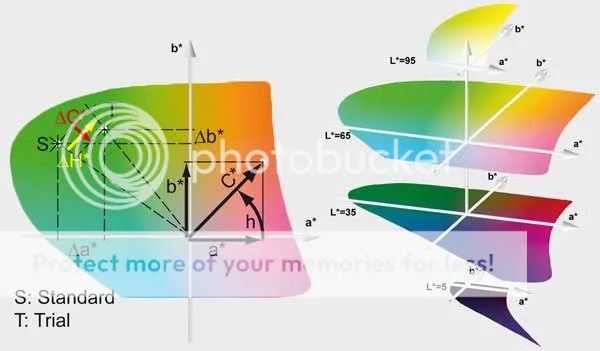

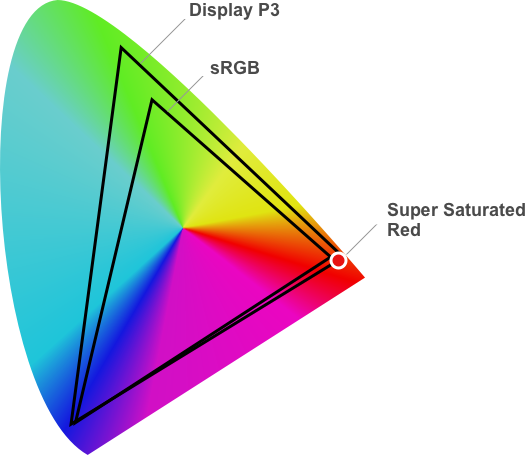

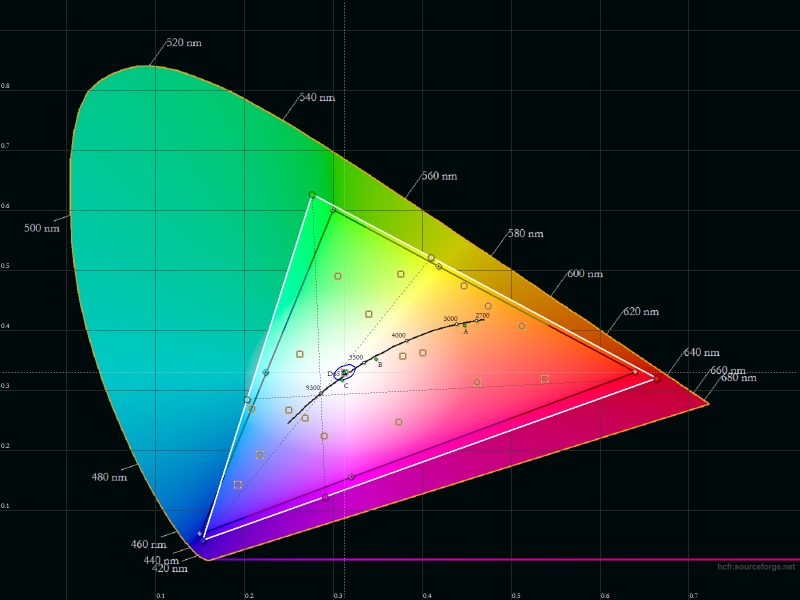

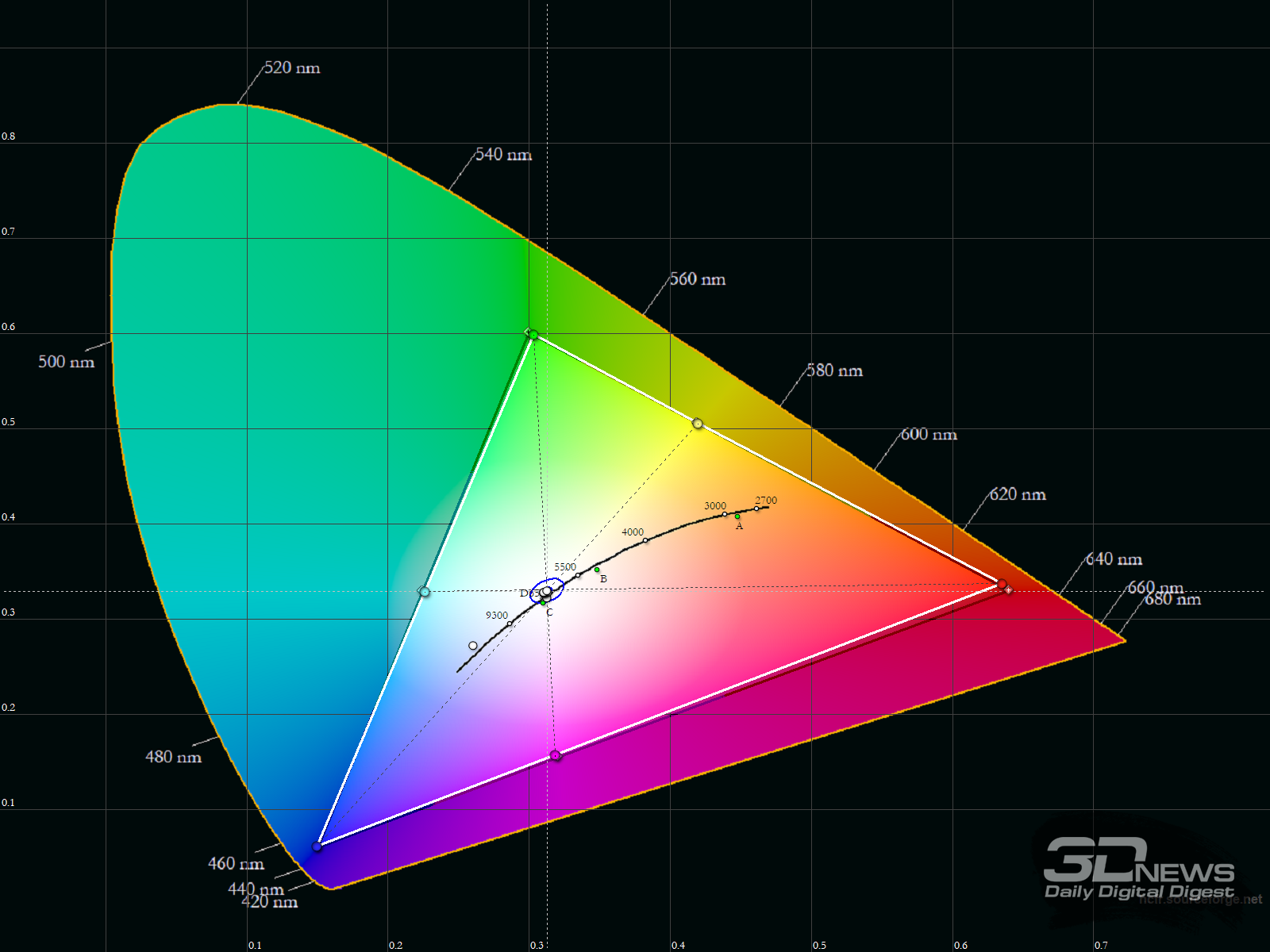

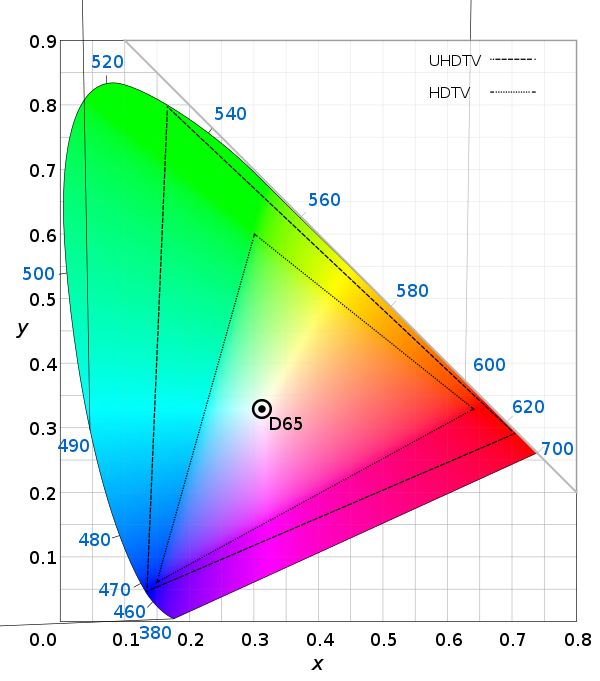

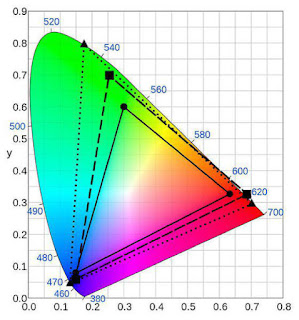

6. Структура формата 4:2:0 (MPEG-1, H.261, H.263)Формат 4:1:1 YCbCr рассматривать не будем ввиду того, что он мало распространен и используется в DV-приложениях. На рис. 7 приведена так называемая хроматическая диаграмма, разработанная в 1931 году CIE (International Commission on Illumination — Международная комиссия по освещению). Уникальность ее в том, что видимый человеческим глазом спектр представлен на ней в виде двухмерной области, целиком лежащей в первой четверти декартовой системы координат. Значения координат получены по следующим формулам:

x=R/(R+G+B)

y=G/(R+G+B)

z=B/(R+G+B)

Координаты называются хроматическими. И, так как одна координата (в данном случае z) может быть получена по известным x и y, она не используется. Эта диаграмма совмещена с областями, которые представляют возможные диапазоны устройств различных стандартов и печатающих устройств (как все неоднозначно в этом мире). Сравнивая области, можно сделать вывод, что современная техника обеспечивает воспроизведение лишь примерно половины видимого спектра.

Рис. 7. Хроматическая диаграмма CIE 1931 г.

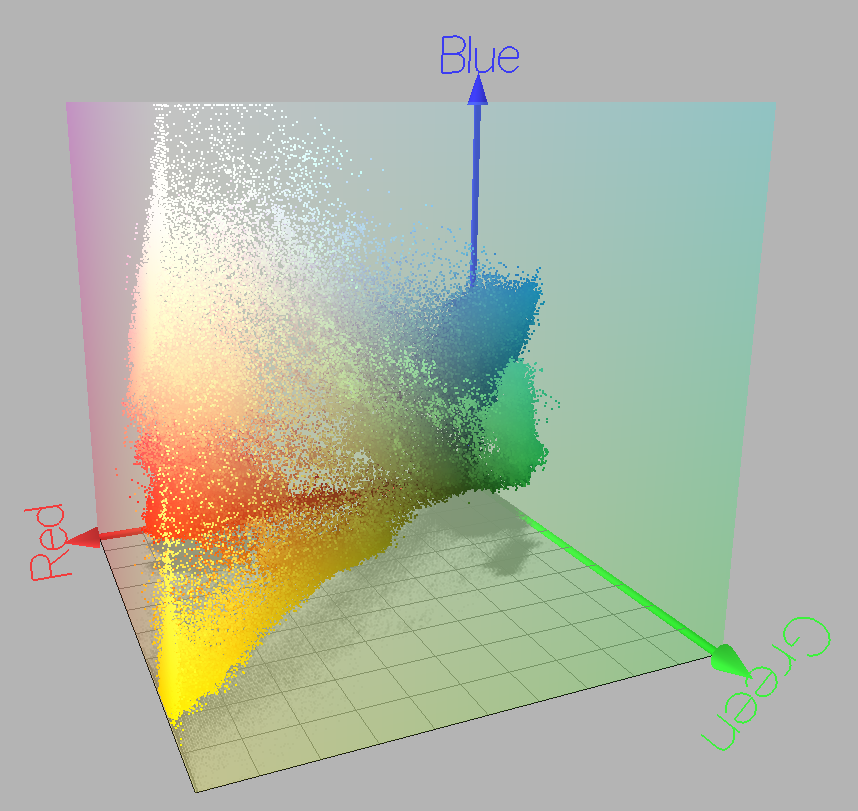

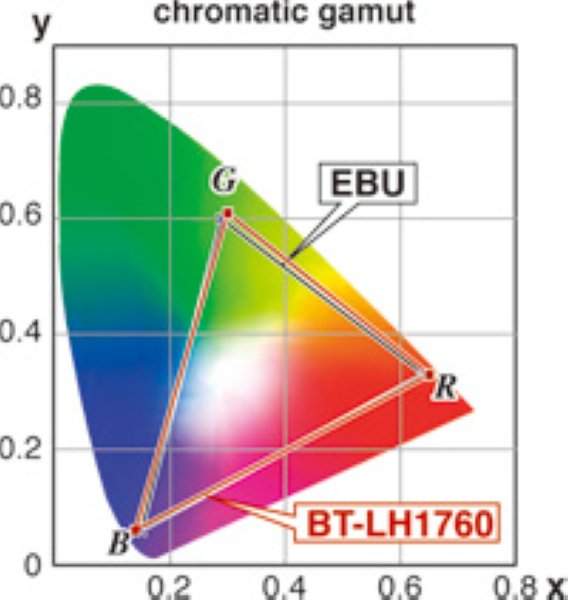

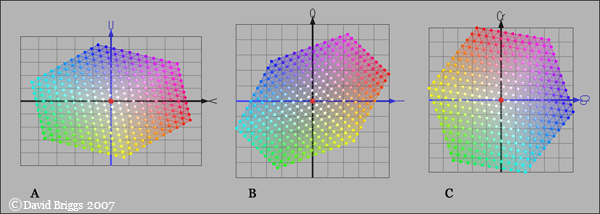

На рис. 8 представлены кубы YCbCr и RGB. Из рисунка видно, что пространство YCbCr шире пространства RGB. В связи с этим напрашивается пара интересных выводов. Учитывая тот факт, что для описания одинакового диапазона цветов в цветовом пространстве используется меньшее количество значений, можно сказать, что произвольная точка будет точнее описана в цветовом пространстве RGB, чем в YCbCr. Хотя, с другой стороны, менее точное цветовое пространство YCbCr передает и меньшее количество шумов. По взаимному расположению кубов сразу становится понятно, почему многие значения YCbCr из допустимых областей могут давать недопустимые значения RGB.

Рис. 8. Относительное расположение кубов RGB и YCbCr

Подведем итоги. Цветовое пространство YUV больше подходит для передачи, обработки и сжатия информации о видео, чем RGB. Конвертация RGB => YUV => RGB приводит к потере части информации о видео, которая происходит на этапе RGB => YUV. Поэтому нецелесообразно захватывать видео в RGB для последующей его обработки, передачи и сжатия в цветовом пространстве YUV. Что касается карт захвата на базе Connexant BT8x8, то для них использование RGB при захвате вообще противопоказано, т.к. «родным» цветовым пространством для них является YUY2. RGB для этих карт при захвате видео можно получить только программно.

Поэтому нецелесообразно захватывать видео в RGB для последующей его обработки, передачи и сжатия в цветовом пространстве YUV. Что касается карт захвата на базе Connexant BT8x8, то для них использование RGB при захвате вообще противопоказано, т.к. «родным» цветовым пространством для них является YUY2. RGB для этих карт при захвате видео можно получить только программно.

При подготовке статьи были использованы материалы книги Video Demystified и сайта FOURCC — информационного ресурса о цветовых пространствах и кодеках.

Ссылки:

FOURCC: сайт

Сайт книги «Video Demystified»: сайт (автор Keith Jack)

Продолжение следует

Maxe Erte the Mad, [email protected]

Компьютерная газета. Статья была опубликована в номере 21 за 2006 год в рубрике софт

Какое цветовое пространство использовать для яркости, YUV или HSL?

Предположим, что у нас есть фотография, сделанная при недостаточном освещении. Изображение темнее, чем обычно, но все еще узнаваемо.

Изображение темнее, чем обычно, но все еще узнаваемо.

Теперь мы хотим сделать его ярче, чтобы он выглядел как взятый при достаточном освещении.

Должны ли мы преобразовать изображение в YUV и настроить канал Y (яркость), или преобразовать в HSL и настроить канал L (яркость)?

Формулировка кажется мне похожей, в то время как их формула сильно отличается:

Г: 0.299*R + 0.587*G + 0.114*B

L: 0.5*(max + min), в то время как max / min-это значение max / min среди RGB

EDIT:

Более конкретно, я собираюсь использовать opencv, cv2.cvtColor(), но не уверен, какой входной аргумент лучше подходит для моей потребности: BGR2YUV или BGR2HLS

opencv image-processing computer-visionПоделиться Источник adayoegi 17 мая 2018 в 04:05

1 ответ

- Лучшее цветовое пространство для поиска похожих цветов

Какое цветовое пространство я должен использовать, если я пытаюсь найти все пиксели одного цвета ? Я попытался использовать GrayScale и запустил DFS в точке изображения, где я хочу найти похожие пиксели, которые связаны с ним, но кажется, что это не правильный путь.

Какое цветовое пространство я…

Какое цветовое пространство я… - Какое цветовое пространство используется в устройствах iOS?

Когда я использую Цифровой измеритель цвета MAC для определения цвета RGB экрана, значения RGB могут быть показаны в sRGB, Adobe RGB, original RGBs пробелах и т. д. И они немного отличаются друг от друга. Я хочу использовать эти значения в платформе iOS Xcode и использовать класс UIColor для их…

1

Настройка только Y и L (в YCbCr и HSL) приведет к потере информации, такой как контраст между высокими значениями пикселей. Я предлагаю либо с помощью некоторого аффинного преобразования на М или L

255*(Y(x,y)-min (Y))/(max (Y) — min (Y))

или лучше всего было бы использовать выравнивание гистограммы. Это не только даст яркое изображение, но и с лучшей контрастностью, так что это хорошо для визуализации

Поделиться Garvita Tiwari 17 мая 2018 в 09:33

Похожие вопросы:

Как я могу использовать HSL цветовое пространство в Java?

Я посмотрел на класс ColorSpace и нашел константу TYPE_HLS (которая, по- видимому , просто HSL в другом порядке). Могу ли я использовать эту константу для создания Color из оттенка, насыщенности и…

Могу ли я использовать эту константу для создания Color из оттенка, насыщенности и…

Эталонный алгоритм для изменения перцептивной яркости?

Каков алгоритм бенчмарка для изменения перцептивной яркости пикселя RGB. такие как: если у меня есть RGB (120, 33, 213), то ( … с помощью… (0.299*R + 0.587*G + 0.114*B) ….) я получаю 79.533…

Какое цветовое пространство использует MSPaint? (Окно 7)

Какое цветовое пространство использует MSPaint? (Я считаю, что все MSPaints одинаковы для последних нескольких версий, но это просто для того, чтобы убедиться, что я Windows 7). Казалось бы, что это…

Лучшее цветовое пространство для поиска похожих цветов

Какое цветовое пространство я должен использовать, если я пытаюсь найти все пиксели одного цвета ? Я попытался использовать GrayScale и запустил DFS в точке изображения, где я хочу найти похожие…

Какое цветовое пространство используется в устройствах iOS?

Когда я использую Цифровой измеритель цвета MAC для определения цвета RGB экрана, значения RGB могут быть показаны в sRGB, Adobe RGB, original RGBs пробелах и т. д. И они немного отличаются друг от…

д. И они немного отличаются друг от…

Использует ли цветовая структура .Net цветовое пространство HSB или HSL?

Насколько я понимаю , цветовые пространства HSL и HSB очень похожи, оба используют одно и то же цветовое колесо 0-360 для оттенка и одно и то же значение 0-1 для насыщенности. Единственное различие…

Что такое цветовое пространство по умолчанию для UIColor?

Я не могу найти статью или документ, описывающий, какое цветовое пространство должно использоваться для значений RGB при инициализации экземпляра из класса UIColor. В статье получение правильных…

Почему гамма-коррекция применяется к RGB вместо YUV или аналогичного?

Насколько я понимаю, гамма-коррекция применяется для настройки высокого диапазона яркости в реальном мире на относительно низкий диапазон яркости в дисплеях. И если это цель-настроить яркость,…

Преобразуйте YUV в HSL или HSV, минуя шаг RGB

Википедия и множество интернет-ресурсов предоставляют подробную и обильную помощь с различными преобразованиями цветового пространства от / до RGB. Мне нужно прямое преобразование YUV->HSL/HSV . На…

Мне нужно прямое преобразование YUV->HSL/HSV . На…

Какое цветовое пространство RGB используется Matplotlib?

Какое цветовое пространство RGB используется Matplotlib? Меня особенно интересует, является ли это sRGB . Определение Matlab от RGB : RGB и RGBA — это последовательности, состоящие соответственно из…

Цифровое представление цвета — Викиучебник

Белая стена, освещённая тремя прожекторами Три пятна краски на белой бумаге, освещённые белым светомЦвет — это очень субъективное понятие. В природе существуют световые волны разной частоты. Исследования показали, что определённый диапазон частот (видимый свет) воспринимается человеческим глазом. Но воспринимается не каждая волна по отдельности, а их совокупность.

Причём есть три основных частоты, «смешивая» которые можно получить почти все воспринимаемые человеком цвета. Если эти частоты излучаются отдельно (например, лазером), то воспринимаются они как красный, зелёный и синий цвета. Отсюда родилась модель RGB. Она очень удобна для технической реализации в устройствах, которые свет излучают (мониторы и проекторы). Так как там из одной точки можно «посветить» тремя цветами разной интенсивности и таким образом, используя только 3 основных цвета, получать почти весь видимый спектр.

Отсюда родилась модель RGB. Она очень удобна для технической реализации в устройствах, которые свет излучают (мониторы и проекторы). Так как там из одной точки можно «посветить» тремя цветами разной интенсивности и таким образом, используя только 3 основных цвета, получать почти весь видимый спектр.

Надо понимать разницу между возможностью контролировать свет излучаемый и поглощаемый.

Если на белую стену посветить красным, зелёным и синим прожекторами, то на пересечении областей мы получим участки, которые «излучают» сразу два цвета: красный + зелёный = yellow, зелёный + синий = cyan, синий + красный = magenta. В данном случае мы контролируем излучаемый свет, тем самым добавляя основные цвета друг к другу в нужных пропорциях (аддитивная модель).

Но представим ситуацию, когда мы не можем излучать свет самостоятельно. Это случай журналов и картин. В природе естественным является белый свет — смесь волн разной частоты, но примерно одинаковой энергии (тепловое излучение). Когда этот свет попадает на поверхность, покрытую определённым веществом, волны одних частот от неё отражаются, волны других частот поглощаются веществом. Тогда можно взять три основных вещества (краски), которые по отдельности отражают только цвета cyan, magenta и yellow, и, смешивая их в определённой пропорции, получить почти все существующие цвета. Таким образом мы контролируем поглощаемый свет, вычитая из белого ненужные нам цвета (субтрактивная модель).

Когда этот свет попадает на поверхность, покрытую определённым веществом, волны одних частот от неё отражаются, волны других частот поглощаются веществом. Тогда можно взять три основных вещества (краски), которые по отдельности отражают только цвета cyan, magenta и yellow, и, смешивая их в определённой пропорции, получить почти все существующие цвета. Таким образом мы контролируем поглощаемый свет, вычитая из белого ненужные нам цвета (субтрактивная модель).

Например, смешивая cyan (голубой; поглощает красный, отражает зелёный и синий) и magenta (розовый; поглощает зелёный, отражает красный и синий) мы получаем поверхность, которая поглащает красный и зелёный и, соответственно, отражает только синий. Отсюда появилась цветовая схема CMYK, которая используется при печати. «K» означает четвёртую, чёрную, краску. Её используют по техническим соображениям.

Цветовые модели[править]

XYZ[править]

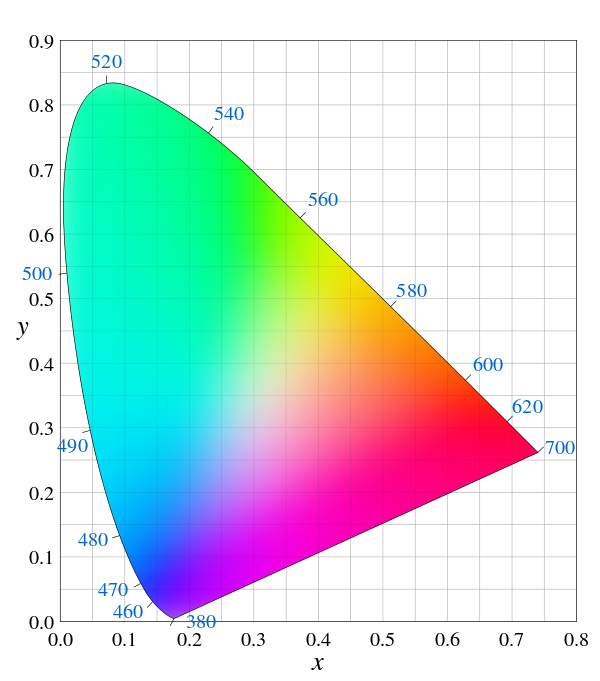

плоскость xy (отмечена на изображении XYZ синим срезом). На краю, обведённом чёрным, находятся монохроматические цвета. Соответствующая им длина волны подписана синим.

На краю, обведённом чёрным, находятся монохроматические цвета. Соответствующая им длина волны подписана синим.XYZ — теоретическая модель, созданная CIE (Commission internationale de l’éclairage) на основе исследований человеческого цветовосприятия. Эта модель вмещает все видимые человеку цвета. Она разработана таким образом, что два компонента представляют цвет, а третий — яркость (Y).

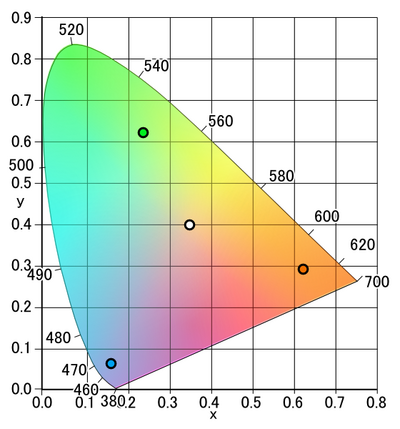

xyY[править]

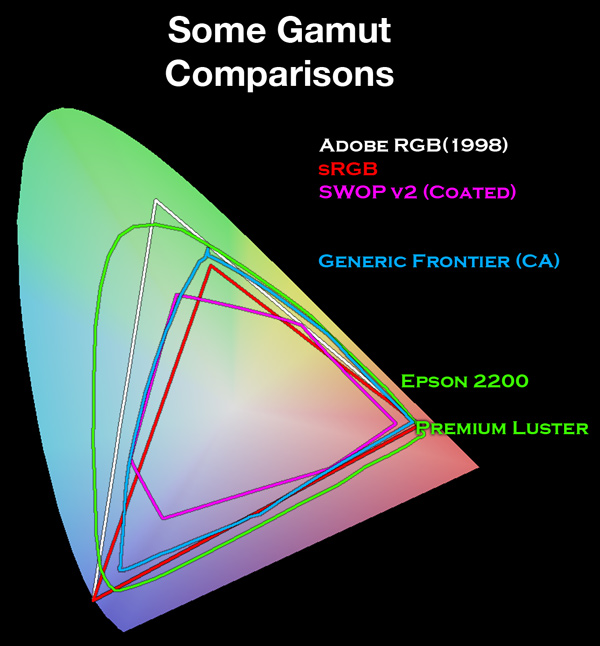

Для иллюстраций используют модель xyY, получающуюся из XYZ простыми преобразованиями. При этом трёхмерными изображениями обычно не заморачиваются и компонент яркости отбрасывается. Получающаяся диаграмма xy имеет одно замечательное свойство: если выбрать на ней три основных (primary) цвета, то внутри образуемого ими треугольника окажутся все цвета, которые можно представить при помощи этих праймари. Вообще, это распространяется на любой n-угольник. На этом свойстве и основана модель RGB.

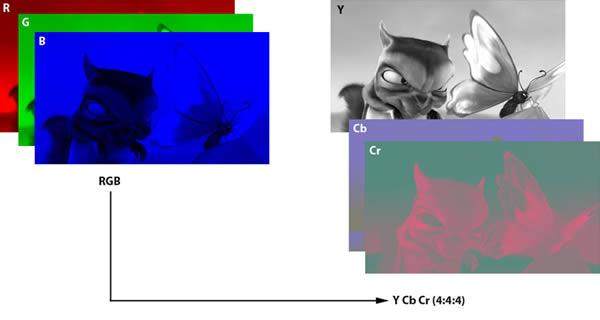

RGB и YCbCr[править]

RGB удобна для захвата цветов камерой и воспроизведения их на мониторе или проекторе. Однако для передачи и кодирования сигнала она мало пригодна по нескольким причинам:

Однако для передачи и кодирования сигнала она мало пригодна по нескольким причинам:

- Считается, что человеческий глаз больше замечает изменения яркости, чем цветности. Модель RGB не позволяет это использовать.

- Когда появилось цветное телевидение, необходимо было сохранить совместимость с чёрно-белыми телевизорами.

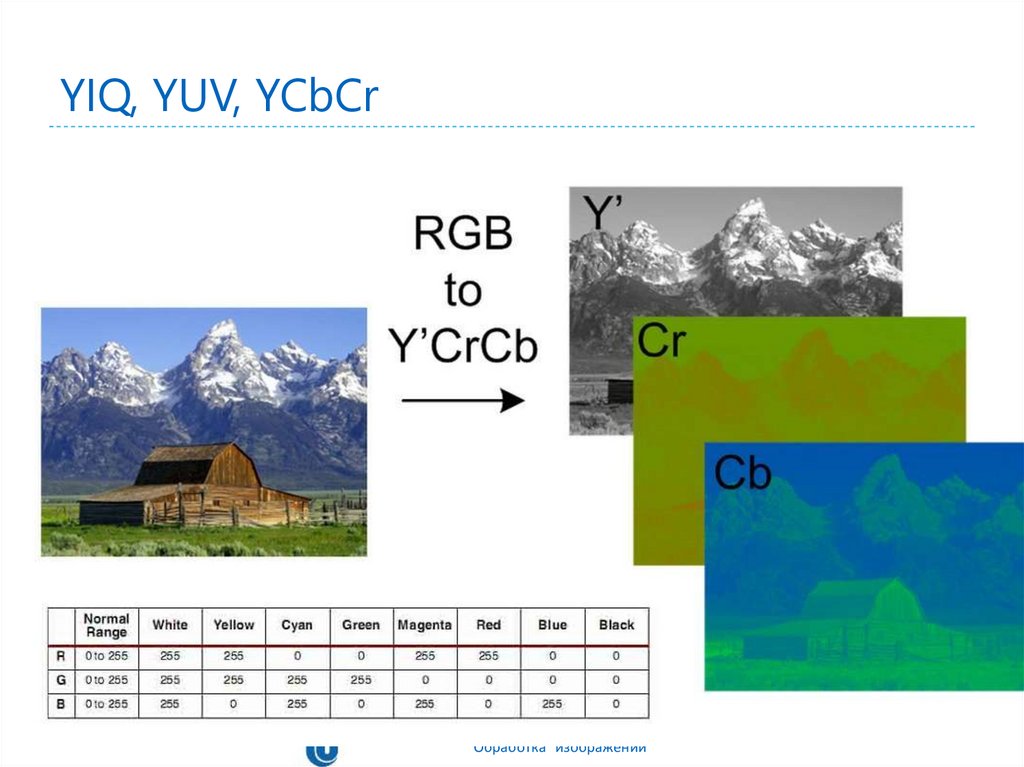

Поэтому для передачи цветного сигнала была разработана модель YUV, которая использовала один компонент (Y) для передачи яркости (чёрно-белое телевидение) и два дополнительных компонента (UV) для передачи цвета. В цифровом кодировании схожая модель зовётся YCbCr.

Цветовые пространства[править]

ITU-R BT.709, EBU Tech. 3213, SMPTE C (SMPTE RP 145), sRGB

Цветовое пространство (gamut) модели RGB определяется выбором праймари и точки белого. Часто выбор диктуется некими практическими соображениями, например, наличием в производстве соответствующего люминофора.

CIE RGB[править]

Это пространство основано на трёх монохроматических цветах.![]() E — точка белого.

E — точка белого.

sRGB[править]

Стандарт, созданный HP и Microsoft в 1996 году. Данный стандарт применяется повсеместно: компьютерные мониторы, интернет, принтеры…

Преобразование из RGB в YCbCr выполняется по формуле:

Y=KR⋅R+KG⋅G+KB⋅BCB=0.5⋅B−Y1−KBCR=0.5⋅R−Y1−KR{\displaystyle {\begin{aligned}Y&=K_{R}\cdot R+K_{G}\cdot G+K_{B}\cdot B\\C_{B}&=0.5\cdot {\frac {B-Y}{1-K_{B}}}\\C_{R}&=0.5\cdot {\frac {R-Y}{1-K_{R}}}\end{aligned}}}

Причём, KG=1−KR−KB{\displaystyle K_{G}=1-K_{R}-K_{B}}.

Коэффициенты KR{\displaystyle K_{R}} и KB{\displaystyle K_{B}} (matrix coefficients) зависят от используемого цветового пространства и отдельно определяются соответствующими стандартами. При этом стандарты, использующие одинаковые праймари и точку белого, могут декларировать разные коэффициенты преобразования, и наоборот.

Гамма-коррекция[править]

Воспринимаемая человеком яркость изображения (lightness) нелинейно зависит от «реальной» яркости (luminance): тёмные оттенки человек различает лучше чем светлые. Чтобы избежать неравномерных потерь при передаче и кодировании сигнала, линейные значения RGB или YCbCr должны быть преобразованы в нелинейные R′G′B′ или Y′CbCr. Такое преобразование называется гамма-коррекцией. Сама функция преобразования (transfer characteristics) определяется различными стандартами по-разному.

Чтобы избежать неравномерных потерь при передаче и кодировании сигнала, линейные значения RGB или YCbCr должны быть преобразованы в нелинейные R′G′B′ или Y′CbCr. Такое преобразование называется гамма-коррекцией. Сама функция преобразования (transfer characteristics) определяется различными стандартами по-разному.

В теории гамма-коррекция должна производиться после конвертации RGB → YCbCr при записи данных, а обратное преобразование — перед конвертацией YCbCr → RGB при воспроизведении. То есть RGB → YCbCr → Y′CbCr → … → Y′CbCr → YCbCr → RGB. На практике же применяется цепочка RGB → R′G′B′ → Y′CbCr → … → Y′CbCr → R′G′B′ → RGB. Эта инженерная уловка использовалась для того, чтобы избежать двойного преобразования в ЭЛТ-мониторах. Яркость пикселя на таком мониторе нелинейно зависит от подаваемого напряжения, причём эта зависимость очень похожа на функцию обратной гамма-коррекции. Компонент Y′ (luma), полученный из R′G′B′, не соответствует теоретической яркости Y (luminance), получаемой из RGB. Это приводит к определённым артефактам, проявляющимся при использовании chroma subsampling (например, тёмная полоска на границе зелёный — маджента).

Это приводит к определённым артефактам, проявляющимся при использовании chroma subsampling (например, тёмная полоска на границе зелёный — маджента).

Как уже упоминалось, считается, что человек сильнее воспринимает изменения яркости, чем изменения цветности. Так как YCbCr кодирует яркость (Y) и цветность (CbCr) отдельно, то эта особенность человеческого восприятия позволяет сохранять компоненты цветности с меньшим разрешением, чем компонент яркости. Называется это chroma subsampling.

Расмотрим 2 строки по 4 пикселя в каждой. В обычном случае мы имеем по 4 значения Y для каждой строки, и по 4 значения Cb и Cr для каждой из двух строк. Это описывается соотношением 4:4:4.

В общем виде записывается как J:a:b, где J — ширина рассматриваемой строки (всегда равна количеству Y-сэмплов в каждой из строк), a — количество Cb и Cr сэмплов в первой строке, b — количество Cb и Cr сэмплов во второй строке.

Например, «4:2:0»: 4(сэмпла яркости на каждую строку):2(сэмпла цветности на первую строку):0(сэмплов цветности на вторую строку — используется тот же цвет, что и в первой строке). Таким образом, на блок из четырёх пикселей приходится только один сэмпл цветности. Это наиболее используемый и поддерживаемый тип сабсэмплинга.

Таким образом, на блок из четырёх пикселей приходится только один сэмпл цветности. Это наиболее используемый и поддерживаемый тип сабсэмплинга.

Несмотря на то, что визуально chroma subsampling почти не заметен, в некоторых случаях при преобразовании обратно в RGB могут возникать видимые артефакты. Проявляются они либо на видео низкого разрешения с текстом (в этом случае перед кодированием стоит сделать апскейл), либо при переходах между некоторыми цветами (чёрный-красный, зелёный-маджента), либо на специальных тестовых изображениях.

Для передачи цифрового сигнала чаще всего используется 8 бит на сэмпл. То есть Y, Cb и Cr могут принимать значения 0..255. Однако, из-за аналоговой природы большинства телевизионных стандартов, для видео используется не весь диапазон значений.

Согласно стандартам (BT.601, BT.709) чёрному цвету должно соответствовать Y = 16, белому Y = 235. Для Cb и Cr базовыми являются значения 16 и 240. Таким образом, яркость имеет 220 уровней (quantization levels), цветность — 225. {BitDepth-1}}). В H.264 для такого сигнала предусмотрен флаг Full range.

{BitDepth-1}}). В H.264 для такого сигнала предусмотрен флаг Full range.

Воспроизведение[править]

Для корректного воспроизведения видео должны быть выполнены следующие шаги:

- Выбор базовых уровней входящего сигнала.

- Chroma upsampling.

- Конвертация YCbCr → RGB с использованием правильных коэффициентов.

- Дополнительная коррекция изображения для конкретного устройства вывода.

Выбор уровней[править]

В некоторых случаях входящий сигнал может содержать полезную информацию в областях BTB/WTW. Студийные мониторы должны корректно отображать такие цвета. Однако к домашнему оборудованию и условиям просмотра предъявляются гораздо более мягкие требования, и более комфортным может оказаться отображение только уровней 16..235. Иначе говоря, нужно определиться, будете ли вы масштабировать сигнал 16..235 в 0..255 или будете сохранять области BTB/WTW (в которых ничего полезного может и не быть), жертвуя контрастом.

При выполнении преобразования YCbCr → RGB в ffdshow есть возможность как автоматического выбора между Full range и TV-диапазоном (учитывая и флаг H. 264), так и ручной установки уровней Y (количество уровней CbCr изменяется пропорционально).

264), так и ручной установки уровней Y (количество уровней CbCr изменяется пропорционально).

Также в ffdshow имеется фильтр Levels, позволяющий динамически изменять диапазон при появлении BTB/WTW. Но, так как этот фильтр работает с 8-битными значениями, его использование может привести к появлению banding’а.

Полностью сохранить сигнал в областях BTB/WTW можно также, установив входные уровни YCbCr равными 16..235(240) и уровни вывода RGB равными 16..235. При этом стоит убедиться, что уровни 1..15 и 236..254 нигде не обрезаются.

То, что уровни могут быть изменены сразу в нескольких местах (рендерер, декодер, промежуточные фильтры, настройки видеокарты, шейдеры), может привести к нежелательным последствиям, например, к двойному преобразованию 16..235 → 0..255.

Ресайз[править]

Методы ресайза в madVR

Ресайз (resize — изменение размеров) при просмотре видео выполняется по нескольким причинам:

- chroma upsampling;

- соотношение сторон пикселя (Sample Aspect Ratio) отличное от 1:1;

- несоответствие разрешения видео разрешению монитора.

То есть, даже если вы смотрите 720p на соответствующем мониторе, вам всё равно необходим качественный метод ресайза для компенсации chroma subsampling. Ресайз, как правило, выполняется рендерером. Наиболее продвинутым в этом плане является madVR. VMR9, EVR Custom и Haali renderer также позволяют в некоторой степени изменять метод ресайза.

YCbCr → RGB[править]

Коэффициенты преобразования YCbCr → RGB могут отличаться для контента различной природы. Так, для SD-видео обычно используются коэффициенты описанные в стандарте BT.601, а для HD — BT.709. При использовании неверных коэффициентов происходит слабо заметное искажение цветов. Например, лица людей становятся розовее или желтее.

Многие форматы (H.264, MPEG-2, VC-1, Theora, JPEG SPIFF) поддерживают указание matrix_coefficients в виде метаинформации. Однако наиболее распространён метод выбора коэффициентов на основании разрешения видео. Например, рендереры VMR7 и VMR9 используют BT.601, если высота кадра < 720, а BT. 709, если высота ≥ 720. Таким образом, видео 720p, кропнутое по высоте, будет воспроизводиться с неправильными коэффициентами. ffdshow использует более разумные критерии:

709, если высота ≥ 720. Таким образом, видео 720p, кропнутое по высоте, будет воспроизводиться с неправильными коэффициентами. ffdshow использует более разумные критерии:

- если установлен флаг в потоке H.264, то используются соответствующие коэффициенты;

- для Fraps используется BT.709;

- для JPEG и M-JPEG — BT.601;

- если высота ≥ 600 или ширина > 1024 — BT.709;

- если высота < 600 и ширина ≤ 1024 — BT.601.

Также компенсировать неверный выбор коэффициентов можно используя шейдеры в MPC-HC.

Преобразование в RGB подразумевает предварительный chroma upsampling. Качественно его могут выполнять, например, ffdshow и madVR. Первый делает это программно, второй — нещадно используя ресурсы видеокарты.

Говорят, что информация о праймари, коэффициентах и гамме может содержаться не только в метаданных, но и в самом потоке: «Some digital video signals can carry a video index (see SMPTE RP 186—1995) which explicitly labels the primaries, transferFunction, and matrix of the signal. »

»

Дополнительный рендеринг[править]

Эффект Бартлесона — Бренемана. Квадраты в каждом ряду имеют одинаковый цвет. Тем не менее, на более тёмном фоне они кажутся светлее. Причём, чем темнее цвет квадрата, тем больше на нём сказывается эффект окружения. Это и вызывает разницу в контрастности между столбцами.В некоторых случаях может понадобиться дополнительная коррекция изображения. Например, изменение цветового пространства и гаммы в соответствии с параметрами монитора. Это можно сделать с помощью yCMS (madVR, AviSynth) или ICC-профиля.

Необходимо понимать, что на восприятие человеком изображения влияет множество вторичных факторов, среди которых:

- Эффект Стивенса (Stevens effect) — воспринимаемая контрастность увеличивается с увеличением яркости.

- Эффект Бартлесона — Бренемана (Bartleson-Breneman effect) — более тёмная окружающая обстановка уменьшает воспринимаемую контрастность.

- Эффект Ханта (Hunt effect) — насыщенность увеличивается с увеличением яркости.

Например, цветы при дневном свете (около 30000 cd/m2) выглядят красочнее, чем при сумеречном (около 300 cd/m2). Если изображение снято днём, но отображается на мониторе яркостью 300 cd/m2 без модификации данных RGB, то будет казаться, что оно было снято в сумерках.

Например, цветы при дневном свете (около 30000 cd/m2) выглядят красочнее, чем при сумеречном (около 300 cd/m2). Если изображение снято днём, но отображается на мониторе яркостью 300 cd/m2 без модификации данных RGB, то будет казаться, что оно было снято в сумерках.

Традиционно для компенсации этих эффектов при воспроизведении используется несколько большее значение гаммы, чем было использовано при съёмке камерой. Так, студийные мониторы, предназначенные для просмотра в тёмном окружении, используют γ ≈ 2.4, в то время как при съёмке используется кривая с показателем 1/γ ≈ 1/2. Для мониторов, используемых в светлых помещениях, подойдёт γ ≈ 2.2 (sRGB).

Ресайз[править]

Для правильного ресайза должны использоваться линейные, а не гамма-корректированные значения компонентов. При ресайзе в большее разрешение это не существенно, однако при уменьшении разрешения неверный ресайз может приводить к заметным проблемам.

Встроенные функции Avisynth этого не учитывают, а кроме того, имеют ряд багов chroma shift, часть из которых не исправлена и в версии 2. 6a3.

6a3.

Ресайз над линейными компонентами можно производить при помощи Dither Tools (пример) или ResampleHQ. Однако в последнем присутствуют некоторые баги.

Коррекция коэффициентов[править]

Если при создании рипа производится ресайз из HD в SD, то следует скорректировать значения YCbCr так, чтобы при воспроизведении цвета не искажались из-за ошибочного выбора коэффициентов (для SD традиционно используются BT.601, для HD — BT.709). В Avisynth это можно сделать выполняя ресайз при помощи Dither Tools или ResampleHQ, а также плагинами ColorMatrix и t3dlut. Сама по себе коррекция коэффициентов не требует преобразования в RGB.

При кодировании следует указывать используемые коэффициенты в метаданных (параметр —colormatrix для x264). Эта информация может использоваться либо когда конвертация в RGB производится декодером, либо отдельными связками декодер + рендерер (LAV Video + madVR). В большинстве же случаев флаг colormatrix игнорируется и коэффициенты выбираются на основе разрешения видео. {0.45}-0.1115,&{\mbox{for }}1\geq L_{c}\geq 0.0228\\4.0\cdot L_{c},&{\mbox{for }}0.0228>L_{c}\geq 0\end{cases}}}

{0.45}-0.1115,&{\mbox{for }}1\geq L_{c}\geq 0.0228\\4.0\cdot L_{c},&{\mbox{for }}0.0228>L_{c}\geq 0\end{cases}}}

(0.310; 0.595),

(0.155; 0.070),

C (0.3101; 0.3162)

(0.29; 0.60),

(0.15; 0.06),

D65 (0.313; 0.329)

Wratten 58 (0.243; 0.692),

Wratten 47 (0.145; 0.049),

C (0.310; 0.316)

V=Lc,for 1>Lc≥0{\displaystyle V=L_{c},\quad {\mbox{for }}1>L_{c}\geq 0}

V={1. 0+lgLc2,for 1≥Lc≥0.0010.0,for 0.001>Lc≥0{\displaystyle V={\begin{cases}1.0+{\lg L_{c} \over 2},&{\mbox{for }}1\geq L_{c}\geq 0.001\\0.0,&{\mbox{for }}0.001>L_{c}\geq 0\end{cases}}}

0+lgLc2,for 1≥Lc≥0.0010.0,for 0.001>Lc≥0{\displaystyle V={\begin{cases}1.0+{\lg L_{c} \over 2},&{\mbox{for }}1\geq L_{c}\geq 0.001\\0.0,&{\mbox{for }}0.001>L_{c}\geq 0\end{cases}}}

V={1.0+lgLc2.5,for 1≥Lc≥10/10000.0,for 10/1000>Lc≥0{\displaystyle V={\begin{cases}1.0+{\lg L_{c} \over 2.5},&{\mbox{for }}1\geq L_{c}\geq {\sqrt {1}}0/1000\\0.0,&{\mbox{for }}{\sqrt {1}}0/1000>L_{c}\geq 0\end{cases}}}

Примечания[править]

- BT.709-1 указывал коэффициенты KR = 0.2125, KB = 0.0721, но в BT.709-2 они были изменены (Y′CbCr Video in QuickTime, Wilbert’s post).

- BT.709 содержит также Part 1 «HDTV systems related to conventional television», которая определяет другие matrix coefficients для 1250/50/2:1 (KR = 0.299; KB = 0.114). При этом стандарт рекомендует использовать Part 2 при создании нового контента.

- BT.470 — устаревший стандарт аналогового телевидения, в последней редакции которого (BT.470-7) просто рекомендуется использовать BT.1700. Однако его по-прежнему упоминают в том или ином виде. Иногда ещё и с ошибками, как в этом MSDN (перепутали «System B, G» и «System M»). Кстати, в той же статье ссылаются на некий «EBU Tech 3212», видимо, подразумевая EBU Tech 3213.

- BT.1700 ссылается на SMPTE 170M (2004) для описания NTSC.

- SMPTE 170M упоминает, что, в то время как коэффициенты NTSC 1953 публиковались в виде KR = 0.30, KB = 0.11, при разработке спецификации использовались именно KR = 0.299; KB = 0.114.

Источники[править]

Первичные:

- Сами стандарты. Не проверены SMPTE 240M, SMPTE 260M, SMPTE 293M, SMPTE 295M, SMPTE RP 145, SMPTE RP 177, NTSC 1953, IEC 61966-2-4.

Вторичные:

- «Digital Video and HDTV: Algorithms and Interfaces», Charles Poynton

- «The Reproduction of Colour» (6th Edition), R.

W.G. Hunt (перевод Алексей Шадрин)

W.G. Hunt (перевод Алексей Шадрин) - «Video Demystified. A Handbook for the Digital Engineer» (5th Edition), Jack K.

Почему цветовое пространство xvYCC не используется для фотосъемки?

У вас есть вещи почти полностью назад. Это не тот случай, когда фотография может / должна «догнать» видео — наоборот, это вопрос видео, которое наконец-то догнало (примерно) возможности, которые TIFF (для одного примера) предоставляет пару десятилетий назад (или около того).

Хотя вы, конечно, не видели очень много TIFF 16 бит / канал 20 лет назад, такая возможность уже была, и 16 бит / канал (в TIFF и различных других форматах) теперь довольно распространены. В то же время я чувствую себя обязанным отметить, что большинство людей считают 8 бит / канал полностью адекватными. Просто в качестве одного очевидного примера, JPEG2000 поддерживает 16 бит / канал и лучшее сжатие, чем оригинальный JPEG — но нигде даже близко не подходит к использованию оригинальной спецификации JPEG.

Примерно в то же время (на самом деле, немного раньше) xvYCC работала (примерно), догоняя возможности TIFF, формат файла openEXR разрабатывался. Он поддерживает до 32 бит / канал. Хотя он еще не так широко используется, я ожидаю, что он будет немного похож на TIFF и, в конце концов, получит широкое применение.

Что касается цветового пространства, это правда, что большее число бит / пиксель, если xvYCC поддерживает большую гамму, чем sRGB. Опять же, однако, ProPhotoRGB (для одного примера) предоставляет гораздо более широкую гамму — и (честно говоря) остается открытым вопрос, существует ли большая потребность в большем цветовом пространстве, чем уже обеспечивает ProPhotoRGB (примерно 13% цветов, которые вы можете Представлять в ProPhotoRGB в основном воображаемо — они выходят за рамки того, что большинство людей могут воспринимать).

Преимущество xvYCC заключается в уменьшении количества данных, необходимых / используемых для представления заданного уровня качества. Для HD-видео (в частности) минимизация пропускной способности чрезвычайно важна. Для цифровых фотоаппаратов, однако, пропускная способность — гораздо меньшая проблема — хотя было бы неплохо, если бы (например) я мог разместить в два раза больше снимков на CF-карте определенного размера, это не является особенно серьезной проблемой. Относительно мало людей используют наибольшую емкость доступных CF-карт, а стоимость CF-карт не является значительной частью бюджета типичного фотографа.

Для HD-видео (в частности) минимизация пропускной способности чрезвычайно важна. Для цифровых фотоаппаратов, однако, пропускная способность — гораздо меньшая проблема — хотя было бы неплохо, если бы (например) я мог разместить в два раза больше снимков на CF-карте определенного размера, это не является особенно серьезной проблемой. Относительно мало людей используют наибольшую емкость доступных CF-карт, а стоимость CF-карт не является значительной частью бюджета типичного фотографа.

Итог: с точки зрения технических возможностей, xvYCC предоставляет мало того, что еще не доступно.

Изменить: я, вероятно, должен добавить еще один момент. ЖК-дисплеи начали заменять ЭЛТ-мониторы для большинства мониторов примерно в то время, когда цифровые камеры стали широко использоваться, но потребительские ЖК-мониторы только сейчас начинают превышать (или даже приближаться) разрешение цветопередачи 8 бит / канал. Трудно было сильно беспокоиться о наличии 10 или 12 бит / канал, когда обычный монитор мог отображать только около 6.

Также есть небольшая деталь, которая просто не волнует многих людей. Для них качество фотографирования подпадает под критерий «прошел / не прошел». Все, что на самом деле требует большинство людей, — это чтобы картина была достаточно узнаваемой. Я подозреваю, что люди постепенно начинают ожидать большего, но после многих лет, когда Уолгринс (или кто бы то ни было) превращает свою рыжеволосую дочь в блондинку (и т. Д.), Требуется время, чтобы привыкнуть к мысли, что цвет может быть точным вообще.

Изменить: На самом деле есть еще один шаг за пределами JPEG 2000: JPEG XR . Это поддерживает до 32 бит / канал (с плавающей запятой) HDR. Он также определяет формат файла, который может включать все обычные данные типа EXIF / IPTC, встроенный цветовой профиль и т. Д. Относящийся к этому вопросу, который включает значение, указывающее, что файл должен использовать цветовое пространство xvYCC (значение 11в TRANSFER_CHARACTERISTICSэлементе синтаксиса, таблица A. 9, на случай, если кому-то все равно). Похоже, он не используется широко (по крайней мере, пока), но напрямую поддерживает цветовое пространство xvYCC для неподвижных изображений.

9, на случай, если кому-то все равно). Похоже, он не используется широко (по крайней мере, пока), но напрямую поддерживает цветовое пространство xvYCC для неподвижных изображений.

[Основы изображения] Цветовое пространство изображения

ссылка

https://blog.csdn.net/mac_lzq/article/details/56682797

https://blog.csdn.net/lz0499/article/details/77345166

- Цветовое пространство RGB

- Цветовое пространство HSV

- Лаборатория цветового пространства

- YUV цветовое пространство

- Цветовое пространство CMY

- HSL цветовое пространство

- HSB цветовое пространство

- Ycc цветовое пространство

- XYZ цветовое пространство

Цветовое пространство RGB

1. Принцип цветного отображения на компьютерных цветных мониторах и цветных телевизорах одинаков. Все они используют принцип смешения цветов R, G и B. Благодаря излучению трех электронных пучков различной интенсивности внутренняя часть экрана покрыта красным, зеленым и синим цветами. Фосфоресцентные материалы излучают свет и дают цвет. Этот метод представления цвета называется представлением цветового пространства RGB.

Фосфоресцентные материалы излучают свет и дают цвет. Этот метод представления цвета называется представлением цветового пространства RGB.

2. В цветовом пространстве RGB любой цветной свет F может быть сформирован путем добавления и смешивания различных компонентов цветов R, G и B: F = r [R] + r [G] + r [B]. Цветовое пространство RGB также можно описать трехмерным кубом. Когда все три основных цветовых компонента равны 0 (самый слабый), они смешиваются как черный свет, а когда все три основных цветовых изображения равны k (максимум, значение определяется пространством хранения), они смешиваются как белый свет.

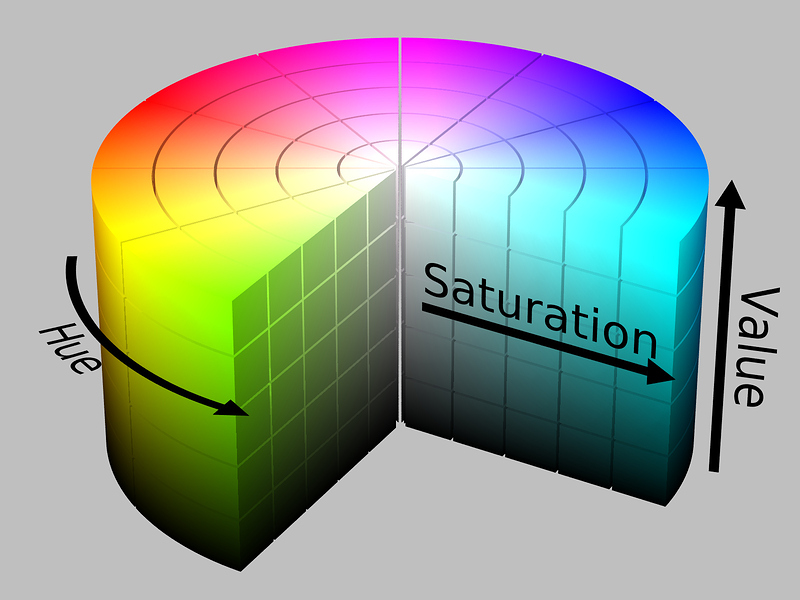

Цветовое пространство HSV

1. HSV — это метод представления точек в цветовом пространстве RGB в перевернутом конусе. HSV — это оттенок, насыщенность и значение, также известные как HSB (B — яркость). Оттенок — это основной атрибут цвета, то есть название цвета, которое обычно говорят, например, красный и желтый. Насыщенность (S) относится к чистоте цвета. Чем выше цвет, тем чище цвет и тем ниже цвет постепенно становится серым. Значение составляет 0-100%. Яркость (V), принять 0-макс (диапазон значений HSV в компьютере связан с длительностью хранения). Цветовое пространство HSV может быть описано моделью конического пространства. В вершине конуса V = 0, H и S не определены, представляя черный цвет. Центр верхней поверхности конуса имеет вид V = max, S = 0, H не определен и представляет белый цвет.

Чем выше цвет, тем чище цвет и тем ниже цвет постепенно становится серым. Значение составляет 0-100%. Яркость (V), принять 0-макс (диапазон значений HSV в компьютере связан с длительностью хранения). Цветовое пространство HSV может быть описано моделью конического пространства. В вершине конуса V = 0, H и S не определены, представляя черный цвет. Центр верхней поверхности конуса имеет вид V = max, S = 0, H не определен и представляет белый цвет.

2. В цветовом пространстве RGB связь между значениями трех цветовых компонентов и сгенерированными цветами не является интуитивно понятной. Цветовое пространство HSV больше похоже на то, как люди воспринимают цвет, инкапсулируя информацию о цвете: «Какой это цвет? Насколько он темный? Насколько он яркий?»

3. Преобразование RGB и HSV

(1) От RGB до HSV

Пусть max будет наибольшим из r, g и b, а min будет самым маленьким. Соответствующее значение (h, s, v) в пространстве HSV:

h составляет от 0 до 360 °, s — от 0 до 100%, а v — от 0 до макс.

(2) От HSV до RGB

Лаборатория цветового пространства

Компонент L в цветовом пространстве Lab используется для представления яркости пикселей. Диапазон значений составляет [0,100], что означает от чистого черного до чистого белого, a означает диапазон от красного до зеленого, а диапазон значений составляет [127, -128] b представляет диапазон от желтого до синего, а диапазон значений [127, -128]. На рисунке ниже показана схема цветового пространства Lab;

YUV цветовое пространство

В современных системах цветного телевидения обычно используется трехкамерная цветная камера или цветная CCD-камера (устройство с точечной связью), которая разделяет сигналы цветного изображения и получает RGB посредством цветового разделения и усиления, а затем получает сигнал яркости через схему матричного преобразования. Y и два цветоразностных сигнала R-Y и B-Y. Наконец, передающая сторона кодирует три сигнала яркости и цветоразностного сигнала отдельно и отправляет их по одному и тому же каналу. Это наше обычно используемое цветовое пространство YUV. Важность использования цветового пространства YUV состоит в том, что его сигнал яркости Y и сигналы цветности U и V разделены. Если присутствуют только компоненты сигнала Y и нет компонентов U и V, изображение, представленное таким образом, является черно-белым изображением в градациях серого. Цветной телевизор использует пространство YUV для решения проблемы совместимости цветного телевизора и черно-белого телевизора с сигналом яркости Y, так что черно-белый телевизор также может принимать цветные сигналы. Согласно Национальному комитету телевизионной системы и стандарту NTSC, когда яркость белого света выражается Y, его связь с красным, зеленым и синим цветами может быть описана следующим уравнением: Y = 0,3R + 0,59G + 0,11B Это обычно используемая формула яркости. Разница в цвете U и V получается путем сжатия B-Y и R-Y в разных пропорциях. Если вы хотите преобразовать из пространства YUV в пространство RGB, вам нужно только выполнить обратную операцию.

Это наше обычно используемое цветовое пространство YUV. Важность использования цветового пространства YUV состоит в том, что его сигнал яркости Y и сигналы цветности U и V разделены. Если присутствуют только компоненты сигнала Y и нет компонентов U и V, изображение, представленное таким образом, является черно-белым изображением в градациях серого. Цветной телевизор использует пространство YUV для решения проблемы совместимости цветного телевизора и черно-белого телевизора с сигналом яркости Y, так что черно-белый телевизор также может принимать цветные сигналы. Согласно Национальному комитету телевизионной системы и стандарту NTSC, когда яркость белого света выражается Y, его связь с красным, зеленым и синим цветами может быть описана следующим уравнением: Y = 0,3R + 0,59G + 0,11B Это обычно используемая формула яркости. Разница в цвете U и V получается путем сжатия B-Y и R-Y в разных пропорциях. Если вы хотите преобразовать из пространства YUV в пространство RGB, вам нужно только выполнить обратную операцию. Аналогично цветовому пространству YUV является цветовое пространство Lab, которое также описывает цветовые компоненты с точки зрения яркости и цветовой разницы, где L — яркость, а a и b — цветоразностные компоненты, соответственно.

Аналогично цветовому пространству YUV является цветовое пространство Lab, которое также описывает цветовые компоненты с точки зрения яркости и цветовой разницы, где L — яркость, а a и b — цветоразностные компоненты, соответственно.

YUV、YCbCr:

Это цветовое пространство в основном основано на характеристике того, что человеческий глаз чувствителен к яркости по сравнению с цветностью, и разделяет компонент цвета и компонент яркости. Из этого также вытекают принципы ранних черно-белых телевизоров и цветных телевизоров, а конкретная формула преобразования может ссылаться на стандартную формулу МСЭ.

После преобразования трехцветных компонентов RGB в YUV422 объем данных изображения уменьшается на 1/3. Если это YUV420, объем данных уменьшается вдвое. Эти преобразованные данные часто используются для кодирования сжатия изображений.

Есть также несколько алгоритмов улучшения края изображения, которые расширяются в этом цветовом пространстве. Главным образом потому, что информация о цвете и информация о яркости разделены.

Цветовое пространство CMY

CMY — система подбора цвета для смешивания пигментов

RGB — это система согласования цветов с легким смешиванием

C-Cyan Green <Дополнительный цвет> R-Red

M-пурпурный пурпурный <дополнительный цвет> G-зеленый

Y-желтый желтый <дополнительный цвет> B-синий синий

Прежняя система подбора цвета используется в промышленной печати (потому что она печатается с помощью пигментов), но трудно использовать CMY для соответствия черному цвету. Это часто серо-черный цвет, поэтому при фактическом использовании также присутствует черный, K Черный, поэтому система CMYK используется для практической печати в промышленности. C и R противоположны, M и G противоположны, а Y и B противоположны.

HSL цветовое пространство

Цветовое пространство HSL (оттенок, насыщенность, яркость), это цветовое пространство является цветовым представлением графической программы пользователя для настольных компьютеров, с шестиугольными конусами для представления собственной цветовой модели.

HSB цветовое пространство

Цветовое пространство HSB (оттенок, насыщенность, яркость), это цветовое пространство является цветовым представлением графической программы для настольного компьютера пользователя с шестиугольными конусами для представления собственной цветовой модели.

Ycc цветовое пространство

Цветовое пространство изобретено Kodak, поскольку PhotoCd подвергается сжатию режима при сохранении изображений, поэтому PhotoCd использует цветовое пространство Ycc, которое использует яркость в качестве основного компонента, имеет два отдельных цветовых канала и использует цвет Ycc Пространство для сохранения изображений может сэкономить место для хранения.

XYZ цветовое пространство

Международная комиссия по освещению (CIE) провела большое количество нормальных человеческих визуальных измерений и статистики.В 1931 году был создан «наблюдатель стандартной цветности», что положило количественную основу для современной стандартной цветности CIE. Поскольку «стандартный наблюдатель цветности», используемый для калибровки спектральных цветов, появились отрицательные значения стимулов, которые было неудобно вычислять и было трудно понять. Поэтому в 1931 году CIE установил три мнимых основных цвета X, Y, Z на основе системы RGB. Новая система цветности. Сопоставьте его с трехцветным значением изоэнергетического спектра, названным «CIE1931 Standard Chromaticity Observer Spectral Tristimulus Value», называемым «CIE1931 Standard Chromaticity Observer». Эта система называется «стандартной системой цветности CIE1931» или «системой цветности XYZ с углом обзора 2 °». Цветовое пространство CIEXYZ можно слегка преобразовать, чтобы получить цветовое пространство Yxy, где Y принимает значение Y среди трех значений стимула, указывая яркость, а x, y отражают характеристики цветности цвета. Определение следующее: в управлении цветом очень важно выбрать цветовое пространство, не относящееся к устройству. Цветовое пространство, не относящееся к устройству, разработано Международной комиссией по освещению (CIE) и включает два стандарта: CIEXYZ и CIELAB.

Поскольку «стандартный наблюдатель цветности», используемый для калибровки спектральных цветов, появились отрицательные значения стимулов, которые было неудобно вычислять и было трудно понять. Поэтому в 1931 году CIE установил три мнимых основных цвета X, Y, Z на основе системы RGB. Новая система цветности. Сопоставьте его с трехцветным значением изоэнергетического спектра, названным «CIE1931 Standard Chromaticity Observer Spectral Tristimulus Value», называемым «CIE1931 Standard Chromaticity Observer». Эта система называется «стандартной системой цветности CIE1931» или «системой цветности XYZ с углом обзора 2 °». Цветовое пространство CIEXYZ можно слегка преобразовать, чтобы получить цветовое пространство Yxy, где Y принимает значение Y среди трех значений стимула, указывая яркость, а x, y отражают характеристики цветности цвета. Определение следующее: в управлении цветом очень важно выбрать цветовое пространство, не относящееся к устройству. Цветовое пространство, не относящееся к устройству, разработано Международной комиссией по освещению (CIE) и включает два стандарта: CIEXYZ и CIELAB. Они содержат все цвета, которые человеческий глаз может распознать. Кроме того, создание системы измерения цвета CIEYxy создает условия для определенного определения цвета. Однако в этом пространстве значение расстояния между двумя разными цветами не правильно отражает размер различий в восприятии цветов людьми, то есть в карте цветов CIEYxy, широкая емкость цветов в разных положениях и в разных направлениях. Отличается, это неоднородность цветового пространства Yxy. Наличие этого дефекта делает невозможным интуитивно оценивать цвета в пространствах Yxy и XYZ.

Они содержат все цвета, которые человеческий глаз может распознать. Кроме того, создание системы измерения цвета CIEYxy создает условия для определенного определения цвета. Однако в этом пространстве значение расстояния между двумя разными цветами не правильно отражает размер различий в восприятии цветов людьми, то есть в карте цветов CIEYxy, широкая емкость цветов в разных положениях и в разных направлениях. Отличается, это неоднородность цветового пространства Yxy. Наличие этого дефекта делает невозможным интуитивно оценивать цвета в пространствах Yxy и XYZ.

★ YUV — cтатьи о цвете .. Информация

★ YUV

YUV — цветовая модель, в которой цвет состоит из трех составляющих — яркостных и два цветоразностных компонент.

Компоненты YUV определяется на основе компонента RGB (РГБ) следующим образом:

Y = K R (Г = К) ⋅ R 1 − K R (К) − K B (К) ⋅ G K B (К) ⋅ B U = B (Б =) − Y V = R (Х V =) − Y {\свойства стиль отображения значение {\начать{соответствие}г&амп=K_{Р}\cDOT на Р 1-K_{Р}-K_{Б}\cDOT на Г K_{Б}\cDOT на б\\у&амп=с\\V и,=Р-г\\\конец{соответствие}}}

Обратное преобразование в RGB (РГБ)

R = Y (Р =) V G = Y (В Г =) − K R (К) ⋅ V K B (К) ⋅ U 1 (У 1) − K R (К) − K B = Y (К Б =) U {\свойства стиль отображения значение {\начать{соответствие}р&,=г В\\Г&амп=г-{\фрац {K_{Р}\cDOT на в K_{Б}\cDOT на У}{1-K_{Р}-K_{Б}}}\\Б&амп=ю\\\конец{соответствие}}}

Обратное преобразование сохраняет диапазон изменения компонент RGB (РГБ), но диапазон изменения компонент U и V более Y, что не удобно для кодирования и передачи / данных. Поэтому мы вводим нормализации.

Поэтому мы вводим нормализации.

Если мы примем, что компоненты RGB (РГБ) диапазон, надо умножить на 219 и добавить 16, например { R = 219 R ({ Р = 219) 16}.

Модель широко используется в передачи и хранения / видео обработки яркостного компонента содержит. «черно-белое» в черно-белое изображение, а остальные два компонента содержат информацию для восстановления нужного цвета. это было удобно во время появления цветной телевизор для совместимости со старыми черно-белыми телевизорами.

В цветовом пространстве YUV есть один компонент, который представляет яркость сигнала яркости, и два других компонента, которые представляют цветовую насыщенность. В то время как яркость передается со всеми деталями, некоторые детали в компонентах цветоразностных сигнала, нет информации о яркости, могут быть удалены путем понижения разрешения отсчетов фильтрации или усреднения, которое может быть сделано несколькими способами, что есть много форматов для сохранения изображения в цветовом пространстве YUV.

YUV часто путают с цветовым пространством YCbCr, и, как правило, условия YCbCr и YUV используются как синонимы, что приводит к дополнительной путанице. когда дело доходит до видео или сигналов в цифровой форме, особенно в контексте телевизионного вещания, термин «YUV» по сути означает «компоненты yCbCR» с точки зрения одной из рекомендаций BT.601 (БТ.601), BT.709 (БТ.709), BT.2020 (БТ.2020). если говорить о JPEG или MPEG или в контексте обработки изображений, мы ссылаемся на T-REC-T.871 YCbCr (Т-НОЦ-т. 871 YCbCr на).

Цветовая субдискретизация понятным языком – немного отдаем, чтобы много выиграть / Статьи / ProjectorWorld.RU

Автор: Michael J. McNamra, ProjectorCentral.com, 19 марта 2019

Вы когда-нибудь наблюдали сброс кадров или подзависания картинки во время воспроизведения фильмов в Full HD или 4K форматах с компьютера, медиасервера, или при трансляции потокового видео через интернет? Если да, то добро пожаловать в клуб! Это вполне обычные проблемы, связанные с пропускной способностью канала, которые, как правило, можно решить обновлением компьютера, интернет-службы, кабелей HDMI, или всех трех компонентов сразу.

Примечание ProjectorWorld: может быть проще понять данный термин, если вернуться к оригинальному английскому слову «subsampling». Если «Sampling» значит «брать замеры» — например параметры каждого пикселя, то с добавлением приставки «sub-» («под-») мы, стало быть, берем замеры не с каждого пикселя, а с некого их «подмножества». «Subsample» — это «выборка из выборки».

Однако, если бы не повсеместное использование цветовой субдискретизации и различных алгоритмов сжатия данных для хранения видео-данных на ваших Blu-ray и DVD-дисках, жестких дисках и серверах служб интернет-вещания, то проблема эта была бы куда более существенной и труднорешаемой. Все потому, что обе технологии работают сообща, существенно уменьшая требуемую пропускную способность канала и вычислительные мощности, необходимые для отображения видео в высоком разрешении и с частотой кадров 24, 30, 60, и даже 120 кадров в секунду. Без этих технологий лишь самые быстрые компьютеры и графические карты были бы в состоянии обработать и отобразить эти сотни мегабайт-в-секунду видео-данных, генерируемых фильмом в качестве 4K UHD HDR, при этом не сбрасывая кадры и без зависания картинки. К тому же, невероятно большой размер файлов, который потребовался бы для несжатых фильмов в Full HD и 4K, добавил бы много дополнительных часов или даже дней к времени их скачивания у служб потокового вещания; к тому же они бы быстро заполнили все дисковое пространство вашего ПК или медиасервера. Даже если ваше оборудование и интернет-подключение были бы в состоянии справиться с несжатым 4K-контентом, вам бы потребовались топовые кабели HDMI 2.1 и соответствующие интерфейсы у отображающего устройства, чтобы «пропихивать» несжатые видео-данные от плеера к устройству.

К тому же, невероятно большой размер файлов, который потребовался бы для несжатых фильмов в Full HD и 4K, добавил бы много дополнительных часов или даже дней к времени их скачивания у служб потокового вещания; к тому же они бы быстро заполнили все дисковое пространство вашего ПК или медиасервера. Даже если ваше оборудование и интернет-подключение были бы в состоянии справиться с несжатым 4K-контентом, вам бы потребовались топовые кабели HDMI 2.1 и соответствующие интерфейсы у отображающего устройства, чтобы «пропихивать» несжатые видео-данные от плеера к устройству.

Цветовая субдискретизация использовалась с начала эпохи аналогового цветного телевидения, позволяя по узкой полосе пропускания, выделенной для каждого телеканала, одновременно передать черно-белое и цветное изображение, тем самым обеспечивая обратную совместимость с существующими черно-белыми телевизорами. Используемый в области аналогового сигнала термин «Y’UV» относится цветовой модели с субдискретизированным цветом, в которой подканал Y’ содержит нелинейный яркостный сингал* (информацию о яркости, соответствующую воспринимаемым яркости и детализации; в основном данные о яркости берутся из зеленого сигнала), тогда как субканалы U и V содержат цветовой компонент сигнала — красный и синий. Данная модель используется во всем мире для телевещания. Другая аналоговая модель, Y’PbPr, используется в основном для передачи компонентного видео по трем кабелям. В этой модели канал Y’ тоже содержит информацию о яркости (она же содержит основную часть данных, относящихся к цветности и детализации зеленого), тогда как каналы Pb и Pr содержат компонент цветовых данных «Синий минус яркость (Y)» и «Красный минус яркость»). Использование отдельного компонента сигнала для передачи информации о яркости в сочетании с двумя сигналами цветовых различий привело к экономии требуемой ширины канала по сравнению с аналоговым R, G, B сигналом, где каждый канал содержит собственный компонент яркости.

Данная модель используется во всем мире для телевещания. Другая аналоговая модель, Y’PbPr, используется в основном для передачи компонентного видео по трем кабелям. В этой модели канал Y’ тоже содержит информацию о яркости (она же содержит основную часть данных, относящихся к цветности и детализации зеленого), тогда как каналы Pb и Pr содержат компонент цветовых данных «Синий минус яркость (Y)» и «Красный минус яркость»). Использование отдельного компонента сигнала для передачи информации о яркости в сочетании с двумя сигналами цветовых различий привело к экономии требуемой ширины канала по сравнению с аналоговым R, G, B сигналом, где каждый канал содержит собственный компонент яркости.

* Нелинейный сигнал, обозначаемый апострофом, означает, что к сигналу применена гамма-коррекция (прим. ProjectorWorld.ru)

Аналоговая модель Y’PbPr ближе соответствует современным цифровым моделям YCbCr и Y’Cb’Cr’ (яркость, цвет: синий; цвет: красный). Как и в аналоговых моделях, условный знак в виде апострофа означает, что изначальные значения для Красного, Зеленого и Синего пикселя, которые были получены камерой или сгенерированы в графическом приложении, были «субдискретизированы» нелинейным способом, который лучше учитывает различную чувствительность человеческого глаза к цветам и различным уровням яркости. Благодаря пониманию принципов работы глаза был сделан вывод, что именно данные о яркости являются наиболее важным компонентом, необходимым для того, чтобы видеть и различать объекты. При этом часть данных о цвете можно опустить без особого ущерба, в результате чего получаем сжатый сигнал, который экономит дисковое пространство и который проще передавать.

Благодаря пониманию принципов работы глаза был сделан вывод, что именно данные о яркости являются наиболее важным компонентом, необходимым для того, чтобы видеть и различать объекты. При этом часть данных о цвете можно опустить без особого ущерба, в результате чего получаем сжатый сигнал, который экономит дисковое пространство и который проще передавать.

В данной статье мы сосредоточимся на трех наиболее широко используемых уровнях цветовой субдискретизации, которые можно обнаружить в рамках модели Y’Cb’Cr’. Эти уровни обычно выражаются в виде тройного отношения, которое соответствует значениям Y’:C’b:C’r. Если вы истинный видеофил, то наверняка встречались с этими «4:4:4», «4:2:2» и «4:2:0». Такие отношения сообщают нам, примерно следующее: «4 доли яркости к 2-м долям цвета (синего) к 2-м долям цвета (красного).» Отношение 4:4:4 используется для описания «недискретизированных» данных R, G, B. Это означает, что в сигнале равные доли выделены на яркость, цветность синего и цветность красного. «4:4:4» полностью соответствует сигналу RGB, как показано на рисунке выше.

«4:4:4» полностью соответствует сигналу RGB, как показано на рисунке выше.

Высчитываем Y’C’bC’r: Таблица взята из описания стандарта BT.2100 и описывает, как значения Y’C’bC’r высчитываются из изначальных значений R’, G’ и B’, записанных камерой или созданных в графическом приложении. Обратите внимание, что яркостный компонент Y’ содержит преимущественно данные, полученные на основании зеленого канала цветности G’ и практически без участия данных из B’.

Алгоритмы цветовой субдискретизации были созданы чтобы использовать на практике более высокую чувствительность человеческого глаза к оттенкам зеленой части цветового спектра, чем к красной и синей. (Возможно, это результат долгой эволюции человеческого вида в окружении зеленых растений и лесов?) По этой причине яркостный компонент Y’ (см. таблицу выше) и содержит преимущественно данные, которые были получены из зеленого канала. По этой же причине зеленый канал в большинстве цифровых фотографий содержит больше полезных данных, на основании которых можно превратить цветную фотографию в черно-белую (см. фото ниже). Если вы снизите насыщенность цветов на телевизоре или проекторе, то полученные черно-белые изображения на экране будут созданы почти полностью из данных по яркостному каналу, в котором примерно 70% зеленого, 25% красного и лишь 5% синего. В связи с таким «перекосом» нашего зрения в сторону зеленого цвета, цветовая субдискретизация позволяет уменьшить объем информации по цветности, содержащейся в красном и синем каналах, экономя вплоть до 30% трафика (при использовании уровня сжатия 4:2:2) без заметной для большинства зрителей разницы в детализации, цвете или контрастности изображения.

По этой же причине зеленый канал в большинстве цифровых фотографий содержит больше полезных данных, на основании которых можно превратить цветную фотографию в черно-белую (см. фото ниже). Если вы снизите насыщенность цветов на телевизоре или проекторе, то полученные черно-белые изображения на экране будут созданы почти полностью из данных по яркостному каналу, в котором примерно 70% зеленого, 25% красного и лишь 5% синего. В связи с таким «перекосом» нашего зрения в сторону зеленого цвета, цветовая субдискретизация позволяет уменьшить объем информации по цветности, содержащейся в красном и синем каналах, экономя вплоть до 30% трафика (при использовании уровня сжатия 4:2:2) без заметной для большинства зрителей разницы в детализации, цвете или контрастности изображения.

Зеленый канал в большинстве цифровых фотографий вносит больший вклад в черно-белое изображение, чем красный или синий.

Сам по себе метод цветовой субдискретизации позволяет снизить размер файла и требования к полосе пропускания на 30-50% по сравнению с изначальным R, G, B форматом, не приводя при этом к значимой деградации качества изображения. Высший уровень качества 4:2:2 является практически «lossless-сжатием» (без потери качества), зачастую применяемым к изначальному видеоматериалу до монтажа и цветокоррекции, позволяя ускорить процесс редактирования и обработки. Запись у большинства полупрофессиональных видеокамер осуществляется именно в этом формате. В области профессионального кинопроизводства цветовая субдискретизация применяется лишь после того, как несжатый (4:4:4) RGB видеоряд смонтирован и сохранен в качестве мастер-копии. Затем, после цветовой субдискретизации, следует применение общего алгоритма сжатия, который может включать MJPEG, AVC, либо HEVC, каждый из которых потребует меньше вычислительных мощностей и времени для сжатия видео в 4:2:2, чем 4:4:4. Взятые вместе, эти различные методы сжатия данных способны уменьшить размер видеофайла в 5-20 раз, так и не достигнув уровня, при котором качество изображения станет неприемлемым.

Высший уровень качества 4:2:2 является практически «lossless-сжатием» (без потери качества), зачастую применяемым к изначальному видеоматериалу до монтажа и цветокоррекции, позволяя ускорить процесс редактирования и обработки. Запись у большинства полупрофессиональных видеокамер осуществляется именно в этом формате. В области профессионального кинопроизводства цветовая субдискретизация применяется лишь после того, как несжатый (4:4:4) RGB видеоряд смонтирован и сохранен в качестве мастер-копии. Затем, после цветовой субдискретизации, следует применение общего алгоритма сжатия, который может включать MJPEG, AVC, либо HEVC, каждый из которых потребует меньше вычислительных мощностей и времени для сжатия видео в 4:2:2, чем 4:4:4. Взятые вместе, эти различные методы сжатия данных способны уменьшить размер видеофайла в 5-20 раз, так и не достигнув уровня, при котором качество изображения станет неприемлемым.

Как работает цветовая субдискретизация?

4:4:4. В соответствии с приведенными выше толкованием стандарта BT.2100, данные по R, G, B, имеющиеся у каждого пикселя видеокадра, сперва используются для вычисления значений Y’C’bC’r для каждого пикселя. Рисунок выше показывает, как эти данные могли бы храниться в массивах по 8 ячеек – до того, как будет применена субдискретизация цветов. На данный момент нет никаких изменений ни относительно требуемого для хранения видеофайла пространства, ни качества изображения, ни точности цветов или их детализации.

В соответствии с приведенными выше толкованием стандарта BT.2100, данные по R, G, B, имеющиеся у каждого пикселя видеокадра, сперва используются для вычисления значений Y’C’bC’r для каждого пикселя. Рисунок выше показывает, как эти данные могли бы храниться в массивах по 8 ячеек – до того, как будет применена субдискретизация цветов. На данный момент нет никаких изменений ни относительно требуемого для хранения видеофайла пространства, ни качества изображения, ни точности цветов или их детализации.

4:2:2. Формат 4:2:2 считается навысшим уровнем субдискретизации и сохраняет всю информацию по каналу яркости Y’. (Все прочие описываемые нами уровни также сохраняют полную информацию по яркости, и лишь несколько записывающих устройств субдискретизируют яркостный канал до уровня 3 или 2). А вот значения C’b и C’r берутся в два раза реже по горизонтали, чем параметр яркости, и в итоге каждый второй пиксель в каждой строке массива пикселей хранится без данных C’b и C’r, экономя около 30% ширины канала и дискового пространства. Когда эти видеоданные открываются компьютерной программой, медиаплеером или способным напрямую обрабатывать видео в 4:2:2 устройством отображения, то сперва все доступные данные восстанавливаются в несжатом виде, а затем недостающие ячейки с данными C’b и C’r заполняются данными из соседних по горизонтали пикселей (это также называется интерполяцией).

Когда эти видеоданные открываются компьютерной программой, медиаплеером или способным напрямую обрабатывать видео в 4:2:2 устройством отображения, то сперва все доступные данные восстанавливаются в несжатом виде, а затем недостающие ячейки с данными C’b и C’r заполняются данными из соседних по горизонтали пикселей (это также называется интерполяцией).

При субдискретизации 4:2:0 яркостный компонент остается нетронутым, а для улучшения качества изображения, данные о цветовых компонентах могут содержать некую смесь из выброшенных данных.

4:2:0. Теперь все становится чуть запутаннее. При уровне субдискретизации 4:2:0, яркостному каналу все еще позволяется сохраняться в нетронутом виде, но C’b и C’r берутся в два раза реже – не только по вертикали, но и по горизонтали, что дает экономию полосы пропускания и места для хранения порядка 50%. Однако, для улучшения качества, данные, хранящиеся для каждого из оставшихся пикселей могут содержать «смесь» из выброшенных данных (см. рисунок). При этом используются два алгоритма. В итоге, при восстановлении исходного изображения видеоплеером, получается меньше артефактов, более плавные переходы между краями линий в изображении и более тонкие детали, чем если бы просто сохранялась цветность для одного пикселя из четырех (без «смешения» с соседними). Безусловно, более плавные края линий означают, что текст на контрастирующем фоне может выглядеть смазано или нечетко, но данный артефакт изображения также может быть виден при сравнении на компьютерном мониторе с его четким изображением форматов 4:2:2 и 4:4:4.

рисунок). При этом используются два алгоритма. В итоге, при восстановлении исходного изображения видеоплеером, получается меньше артефактов, более плавные переходы между краями линий в изображении и более тонкие детали, чем если бы просто сохранялась цветность для одного пикселя из четырех (без «смешения» с соседними). Безусловно, более плавные края линий означают, что текст на контрастирующем фоне может выглядеть смазано или нечетко, но данный артефакт изображения также может быть виден при сравнении на компьютерном мониторе с его четким изображением форматов 4:2:2 и 4:4:4.

Заключительное слово по цветовой субдискретизации

Происходит ли заметно большее ухудшение качества изображение при использовании метода 4:2:0 по сравнению с 4:2:2, если наша цель — просмотр кинофильмов? Большинство зрителей, просмотревших любое количество Blu-ray дисков в 4K UHD (SDR и HDR) не согласятся с этим. Все потому, что формат цветовой субдискретизации 4:2:0 является неотъемлемой частью стандарта 4K UHD Blu-ray (наряду с невероятно эффективным общим алгоритмом сжатия HEVC) и используется для хранения практически всех фильмов, которые вы можете посмотреть с помощью сервисов кабельного ТВ или широкополосного интернет-вещания. Перед тем, как начать воспроизведение, обычный UHD Blu-ray 4K плеер проверяет информацию HDMI EDID, которая хранится в проекторе или другом устройстве, чтобы определить, способно ли оно напрямую работать с видео в формате 4:2:2. Большинство устройств способны работать с видео в 4:2:0 или 4:2:2, поэтому плеер сперва преобразует данные с диска в формат 4:2:2 перед тем, как отправлять их на экран. Если устройство отображения не совместимо с 4:2:2, то плеер может отправить на него данные в 4:2:0 или же преобразовать их в 4:4:4 перед отправкой на устройство.

Перед тем, как начать воспроизведение, обычный UHD Blu-ray 4K плеер проверяет информацию HDMI EDID, которая хранится в проекторе или другом устройстве, чтобы определить, способно ли оно напрямую работать с видео в формате 4:2:2. Большинство устройств способны работать с видео в 4:2:0 или 4:2:2, поэтому плеер сперва преобразует данные с диска в формат 4:2:2 перед тем, как отправлять их на экран. Если устройство отображения не совместимо с 4:2:2, то плеер может отправить на него данные в 4:2:0 или же преобразовать их в 4:4:4 перед отправкой на устройство.